2025第47卷第4期

服务机器人的应用场景不断拓展,已触及教育、娱乐、医疗康复、家庭、个人和公共服务等各个领域,全球服务机器人市场规模预计2030年将达到

研究表明消费者与类人机器人的接触和互动会对消费者的认知、心理和行为产生重要影响(杜建刚等,2022)。这种影响既可能是积极的,即可以提升消费者对机器人的信赖感(Duffy,2003;Qin等,2023;So等,2024),又可能是消极的,即会使消费者对机器人产生怪异感和心理不适(林子筠等,2021)等。目前营销学者们主要围绕机器人外观拟人化程度探索外观过度拟人化所引发的消极后果以及如何避免(Mende等,2019;Pelau等,2021),而鲜有学者关注感知不匹配(perceptual mismatch)给消费者带来的消极影响(Kätsyri等,2015;Chattopadhyay和MacDorman,2016)。当消费者对机器人的外观与其他维度(如声音、触感和行为等)的拟人化程度感到不匹配时,他们会对类人机器人产生怪异感和心理不适。例如,当服务机器人的外观高度拟人但发出的声音非常机械时,人们认为服务机器人是冰冷的和怪异的(Kätsyri等,2015);当机器人的外观和语言的拟人化程度都比较高时,顾客参与程度则较高(Nguyen等,2023)。当虚拟代理化身(avatar)外观拟人化程度提高时,消费者对其行为拟人化程度的预期也会提高,若虚拟代理化身展现出的外观与行为的拟人化程度不匹配,个体也会感到不适(Miao等,2022)。

类人机器人在服务过程中因执行的任务类型不同(如机器人担任餐厅的点餐员或送餐员、酒店的前台或行李员等),与消费者的互动水平会有高低之分,类人机器人由此表现出的行为可能在社交属性和拟人化程度上也相应地不同,因此机器人外观拟人化水平和行为拟人化程度存在不一致的可能。探索不同互动水平服务场景下服务机器人外观拟人化对消费者接受意愿的影响及其内在机制,对于厘清服务机器人外观与行为的拟人化相似性和理解过度外观拟人化具有重要的理论价值,对于提高消费者对类人机器人的接纳意愿也具有现实意义。

基于拟人化理论,本研究将系统探讨机器人外观拟人化与任务类型如何影响消费者对机器人服务的偏好及其内在机制。本文提出,在高互动性服务情境下,服务机器人展现出的行为拟人化程度较高,此时消费者更信赖外观拟人化程度较高(vs.较低)的机器人;而在低互动性服务情境下,服务机器人展现出的行为拟人化程度较低,此时消费者认为外观拟人化程度较高(vs.较低)的服务机器人更加怪异,会竭力避免与之接触。

二、理论回顾与假设推演(一)拟人化理论

拟人化理论被认为是营销领域服务机器人研究最重要的理论之一(林子筠等,2021)。服务机器人是一种通常在工业环境之外使用的机器人(Lee,2021),被定义为“基于系统的自主性和适应性界面,用于交互、沟通并为组织向客户提供服务的机器人”(Wirtz等,2018)。服务机器人的拟人化设计一般体现在两个方面:外观拟人化设计和行为拟人化设计。相较于行为拟人化设计,外观拟人化设计是更直观的拟人化方式(Kim等,2019)。机器人拟人化是机器人服务研究领域关注的重要内容之一,目前投入市场应用的服务机器人也都带着人类的某些特征(林子筠等,2021)。

服务机器人与拟人化的结合反映了学界和业界对“如何通过技术吸引客户来保持竞争力”这一问题的重视。研究发现,人们的认知、态度和行为会因机器人外观拟人化程度的不同而有所改变(林子筠等,2021),但一直存在两种相互矛盾的结论。一部分学者认为机器人拟人化具有积极影响,机器人表现出的拟人化特征(例如肢体、五官等)越多,人们对机器人的接受程度(Goetz等,2003)和选择偏好(Stroessner和Benitez,2019)也会越高。拟人化是提升消费者对机器人信赖程度的重要因素(Duffy,2003;黄敏学等,2023;Qin等,2023;So等,2024),外观拟人化程度更高的机器人被认为更加聪明和智能(Sääksjärvi和Hellén,2013),认知灵活性更高,产生新颖有用的想法以及解决方案的能力更强(吴继飞等,2020)。外观拟人化较高的服务机器人能够提高消费者的价值共创意愿(刘欣等,2021;Tian等,2024),取得更好的营销效果(Hur等,2015;Kim等,2016)。此外,拟人化将社交线索赋予服务机器人(Nass和Moon,2000;王海忠等,2021),使个体无意识地将社交规则与期望应用到与机器人的交互中。拟人化程度较高的机器人更能启动人类图式(Aggarwal和Mcgill,2012),使个体认为机器人具备了体验和表达情感的能力(Gray和Wegner,2012),更善于社交,从而能够提高人性化感知(Premathilake和Li,2024),有助于建立情感联系和亲密感(Broadbent等,2009;Xie等,2023;Chi等,2024)。

但相关领域的另一些学者认为,外观拟人化具有消极影响。具有人类特征的人工智能设备可能被消费者视为对人类身份的威胁(Pelau等,2021),被员工视为对工作安全的威胁(Wang等,2023),从而导致抵触情绪(Tojib等,2023)。外观拟人化水平较高(vs.较低)的智能客服化身在服务失败情境中会使消费者产生更强的厌恶感,进而导致更加负面的态度(王海忠等,2021)。此外,机器人过度拟人化可能引发“恐怖谷”效应。Mende等(2019)通过实证研究证明了“恐怖谷”效应的存在,外观拟人化水平较高的服务机器人会引起消费者更大的不适感(如怪异感),进而使消费者担忧自己的人类身份受威胁,并采取一系列的补偿性消费行为。

(二)任务类型

任务导向(task orientation)是机器人的三大设计属性之一(Wirtz等,2018),智能服务机器人的不同任务导向会影响消费者行为,如抵触执行主观任务的人工智能(Castelo等,2019),更愿意接受机器人的保健服务(Lee等,2017)等。任务类型的划分主要存在两种方式:一种是依据所执行任务的属性特征进行分类,如实体机器人执行的有形任务与虚拟机器人执行的无形任务(Wirtz和Lovelock,2016)、基于直觉判断的主观任务与基于分析推理的客观任务(Castelo等,2019),以及认知分析任务与情感社交任务(Wirtz等,2018);另一种是根据具体情境对任务内容进行划分,比如数值型数据处理任务与非数值型数据处理任务(Davenport等,2020)、医疗服务领域的医疗与保健服务(Lee等,2017)。在服务过程中,人际互动对顾客非常重要(Dabholkar和Bagozzi,2002),也是消费者接触和接受机器人的主要预测因素之一(Ashfaq等,2020)。因此,本文基于机器人执行服务任务过程中与消费者的互动水平差异,提出了一种新的任务类型划分——高互动性任务与低互动性任务。

为了确保服务机器人顺利执行任务,程序员通过算法为机器人植入特定的程序,预先设定其行为(Wirtz等,2018)。这意味着每一种任务都由“专职”的机器人负责执行,机器人的行为在很大程度上由任务类型决定,任务不同则行为不同。譬如,作为酒店行李员的机器人需要将顾客行李搬运到指定地点,在整个过程中与顾客的互动程度较低;而作为酒店前台的机器人则需要接待顾客并为其办理入住,在这个过程中与顾客的互动程度较高。以往研究表明,不同程度的人际互动会使个体产生不同的行为(Shechtman和Horowitz,2006)。因此,本研究推断,相比于低互动性任务,在高互动性任务中,服务机器人与消费者的互动和交流程度更高,机器人表现出的行为应该更像人且更具社交属性。因为,执行高互动性任务可能需要较高的灵活性和沟通技巧来应对可能出现的复杂且不确定的情况;而执行低互动性任务可能不需要移情能力来理解每位消费者的显性和隐性需求,但需要机械和重复地完成一系列功能性动作,更加注重效率和服务质量的稳定性。例如,在餐厅服务场景中,点餐服务比送餐服务需要更多的人际互动和交流沟通以及更高的移情能力。送餐员的主要职责是保证菜品准确及时送达,而点餐员是餐厅中的导购,通过人际互动和沟通掌握每位消费者的需求,推荐合适的菜品等。因此,对于执行高互动性服务任务的机器人,消费者预期机器人将展现出的行为与人类更加相似;而对于执行低互动性服务任务的机器人,消费者预期机器人将展现出的行为更为机械,行为的拟人化程度较低。

如前文所述,类人机器人会产生积极影响和消极影响,以往研究试图通过拟人化理论来调和这种相互矛盾的结论,并提出适当的外观拟人化能够带来个体对机器人的信赖感等积极影响,但是过度的外观拟人化又将颠覆积极影响,造成不适感和怪异感等消极影响(Tinwell等,2011;杜建刚等,2022)。然而,机器人的外观拟人化达到何种程度属于过度拟人化并没有衡量标准(Mori等,2012),不能准确度量。因此,研究者不再只关注外观拟人化程度,而是提出机器人的外观拟人化与其他维度拟人化(如行为、语音等)不匹配也会带来消极影响(Chattopadhyay和MacDorman,2016;Nguyen等,2023)。当机器人的外形高度像人时,人们期望其展现出的行为也高度像人(Miao等,2022)。其他研究也从侧面证明,消费者希望服务机器人的外观和行为的拟人化程度相一致。例如,有的学者认为尽管机器人拟人化所表现出的社交特质是人类接受度的关键因素,但执行简单唯一任务的机器人不进行外观拟人化似乎会更好(许丽颖和喻丰,2020)。将服务机器人视为功能性工具的美国人,更希望机器人外观是机器形态,并认为拟人化的机器人有用性较低;而认为服务机器人具有社交性的韩国人,对外观拟人化机器人的有用性评价更高(Lee和Šabanović,2014)。

在人际互动需求较大的高互动性任务中,服务机器人所表现出的行为更像人和更具社交属性,此时较高的拟人化外形使消费者感到机器人的外形拟人化与行为拟人化相一致,可能会提升消费者的接触意愿;然而,在人机互动需求较小的低互动性任务中,服务机器人所表现出的行为更为机械,此时较高的拟人化外形导致机器人外形与行为的类人程度不一致,对消费者的接触意愿可能存在负面影响。综上,提出如下假设:

H1:消费者预期执行高互动性(vs.低互动性)任务的机器人会展现出更高(vs.更低)水平的行为拟人化,外观拟人化较高(vs.较低)更可能增强消费者偏好。

H1a:机器人执行高互动性任务时,外观拟人化较高(vs.较低)更可能增强消费者偏好。

H1b:机器人执行低互动性任务时,外观拟人化较低(vs.较高)更可能增强消费者偏好。

(三)怪异感和信赖感的中介作用

怪异感(eeriness)被定义为一种消极的情感状态,是由机器人与人类高度相似但又不完美所引起的负面反应(Choi等,2019),是“恐怖谷”效应(Mori等,2012)的具体表现。但随着研究的深入学者们发现,机器人外形和行为的拟人化不匹配也会导致消极影响,并且比单一的外形极其像人所引起的消极影响更稳定(Chattopadhyay和MacDorman,2016)。譬如,若机器人的外形高度像人而行为却不像人(Cabibihan等,2015),或机器人的行为极其似人而外形却是非人形的形态,个体就会对机器人产生心理不适和怪异感(Saygin等,2012)。低互动性服务任务对移情能力和沟通能力要求较低,消费者认为执行此类任务的机器人是在机械地重复相对简单且固定的动作。相比于低外观拟人化机器人,高外观拟人化机器人执行此类任务可能使消费者认为机器人将要表现出的行为与其外表不匹配,进而导致过度拟人化和怪异感(Chattopadhyay和MacDorman,2016)。因此,个体在面对低互动性服务时不太愿意接受高外观拟人化机器人。

信赖感(trustworthiness)被广泛应用于心理学、社会学等诸多研究领域(Hoff和Bashir,2015),在人机交互领域,信赖感被认为是决定个体接受自主技术(如服务机器人)的基本因素之一(Kessler等,2016)。以往研究表明,机器人拟人化是提升消费者信赖感的重要方式(Duffy,2003;Qin等,2023;So等,2024),因为高拟人化会增强消费者对机器人能够以深思熟虑的方式行事的感知(Waytz等,2010),以及对机器人具有情绪识别、计划和沟通等能力的期望(Gray等,2007)。此外,极其似人的外观使个体认为虚拟代理更有能力做出决策,更值得信赖(Gong,2008)。但拟人化也有可能过度而导致“恐怖谷”效应,增加个体的怪异感(Tinwell等,2011;Gray和Wegner,2012)。只有机器人的外形和行为的类人程度相似才有可能避免拟人化带来的不适和怪异感(Cabibihan等,2015)。要成功执行高互动性服务任务意味着机器人的行为表现与人类极其相似,而机器人外形的高拟人化可能使消费者认为机器人的预期行为与外形相一致,不会出现机器人拟人化过度的问题,进而使消费者更信赖高拟人化机器人。因此,个体在面对高互动性服务时更愿意接受高外观拟人化机器人。

如前所述,服务机器人将要执行的任务很大程度上决定着机器人的行为,对于低互动性任务而言,消费者认为机器人只是在执行一些机械且简单的动作,表现出的行为更像机器而非人类。而外观拟人化设计可能使消费者感到机器人的预期行为与外表在类人程度上不一致,从而认为机器人的外观过度拟人化,进而增强对机器人的怪异感,并降低接触机器人的意愿。相反,对于高互动性任务而言,消费者预期机器人会展现出与人类极为相似的行为(如沟通水平与移情能力等),外观拟人化使消费者感到机器人的预期行为与外形在类人程度上相匹配,更可能认为外观的拟人化水平是适度的,进而提升对机器人的信赖感,更愿意接触机器人。据此,本文提出假设:

H2a:对于执行低互动性任务的拟人化机器人,怪异感在服务机器人外观拟人化对消费者偏好的消极影响中起中介作用。

H2b:对于执行高互动性任务的拟人化机器人,信赖感在服务机器人外观拟人化对消费者偏好的积极影响中起中介作用。

因此,本文的研究模型如图1所示:

|

| 资料来源:本文作者绘制。 图 1 研究模型图 |

实验一的主要目的是验证假设H1a和H1b,即不同任务类型情境下,消费者对拟人化机器人的偏好。

(一)前测

本次前测通过Credamo平台开展三项独立的实验,分别检验实验材料(即机器人拟人化和任务类型)的有效性并排除替代解释。在机器人拟人化的前测中,招募了70名被试,其中女性43人(61.40%),平均年龄Mage=30.59(SD=8.73)岁。在任务类型的前测中,招募了另外70名参与者,其中女性37人(52.90%),平均年龄Mage=30.94(SD=7.70)岁。在排除替代解释的前测中,招募了60名被试,其中女性32人(53.30%),平均年龄Mage=32.13(SD=8.10)岁。向被试支付1元作为实验报酬。

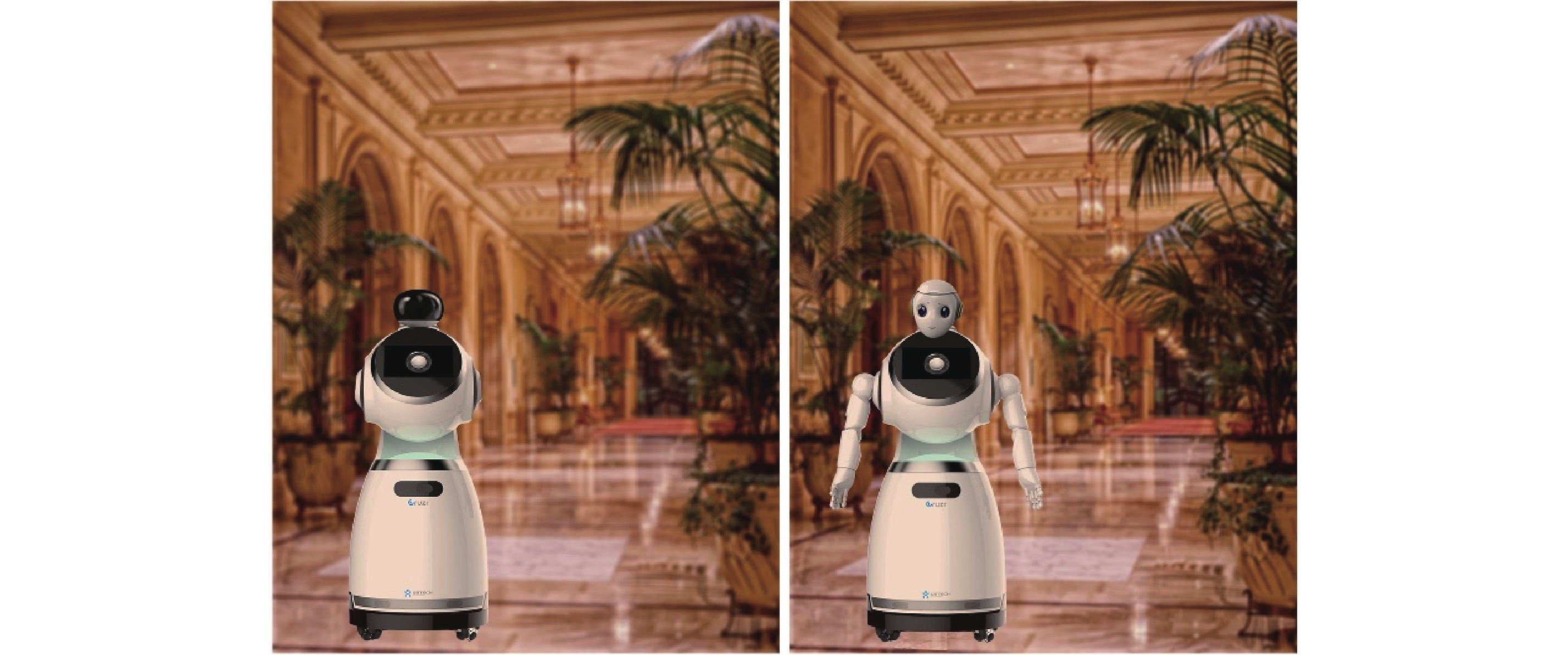

验证机器人拟人化的前测实验采用单因素2水平(拟人化:高vs.低)组间设计。要求被试想象自己入住酒店,并发现酒店使用服务机器人S-1000(或机器人小鲁)为顾客提供部分服务,如图2所示。随后,被试评价服务机器人的拟人化程度(Mende等,2019),“这个服务机器人看起来像人类/像机器”(α=0.955),并评价感知可爱度(雷怡等,2020)和图片吸引力,所有题项皆采用7点里克特量表。最后收集人口统计学信息并致谢。结果显示,被试认为高拟人化机器人比低拟人化机器人的拟人化程度更高(M高拟人=3.96,SD=1.55;M低拟人=2.30,SD=1.48;F(1,68)=20.98,p<0.001)。服务机器人的可爱程度(p=0.384)和图片吸引力(p=0.415)无显著性差异。因此,机器人拟人化的实验材料是有效的。

|

| 资料来源:本文作者自制。 图 2 低拟人化服务机器人S-1000(左)与高拟人化服务机器人小鲁(右) |

验证任务类型的前测实验采用单因素2水平(任务类型:高互动vs.低互动)组间设计。要求被试设想自己外出旅游,来到一家酒店,服务机器人为其办理入住或搬运行李(详见表1),随后,被试评价与酒店服务机器人的互动程度,1代表“互动程度非常低”,7代表“互动程度非常高”,并且被试报告在多大程度上认为服务机器人在此过程中表现出的行为很像人类/像机器(α=0.891),改编自Mende等(2019),1代表“非常不同意”,7代表“非常同意”。最后收集人口统计学信息并致谢。结果显示,相比于提供行李搬运服务的机器人(M低互动=4.66,SD=1.14),被试认为在与提供入住办理服务的机器人接触时(M高互动=5.77,SD=0.88),自己与机器人的互动程度更高,F(1,68)= 21.09,p<0.001。因此,任务类型的实验材料是有效的。相比于提供行李搬运服务的机器人,被试认为提供入住办理服务的机器人会展现出更高水平的行为拟人化(M高互动=4.83,SD=1.27;M低互动=2.79,SD=1.37;F(1,68)=46.05,p<0.001)。由此可见,机器人执行高互动性(vs.低互动性)任务时,个体期望机器人表现出更高水平的行为拟人化。

| 高互动(办理入住) | 低互动(搬运行李) | |

| 任务类型 | 设想你外出旅游,来到一家酒店,前台的服务机器人为你办理入住,并询问你的需求(叫醒服务、美食景点推荐等) | 设想你外出旅游,来到一家酒店,大厅的服务机器人为你搬运行李,并按照你的走路速度引导你到达自己的房间 |

| 资料来源:本文作者自制。 | ||

最后的前测实验主要是为了排除替代解释,即感知智能(Kiesler等,1996)。因为,人们可能认为机器人在执行不同任务时所需的智能水平具有差异,相比于低互动性任务,执行高互动性任务的机器人可能具备更高的智能水平。实验采用2(拟人化:高vs.低)×2(任务类型:高互动vs.低互动)组间设计。实验流程和材料与前两项前测实验相同,但被试除了评价与酒店服务机器人的互动程度和机器人拟人化程度外,还需要报告对服务机器人的智能感知(Kiesler等,1996),共五个题项(α=0.913),1代表“缺乏能力的/不可靠的/笨拙的/机械的/蠢笨的”,7代表“有能力的/可靠的/精明的/智能的/聪明的”。最后收集人口统计学信息并致谢。

结果显示,被试认为高外观拟人化机器人比低外观拟人化机器人的拟人化程度更高(M高拟人=4.85,SD=1.50;M低拟人=3.27,SD=1.79;F(1,56)=13.55,p=0.001)。并且,相比于提供行李搬运服务的机器人(M低互动=5.13,SD=1.42),被试认为在与提供入住办理服务的机器人接触时(M高互动=5.83,SD=0.83),自己与酒店服务机器人的互动程度更高,F(1,56)=5.81,p=0.019。然而,任务类型与机器人外观拟人化的交互项并不影响被试对机器人拟人化程度和互动程度的感知(ps>0.1)。此外,外观拟人化显著影响智能感知(M高拟人=6.09,SD=0.44;M低拟人=5.55,SD=1.31;F(1,56)=4.85,p=0.032);任务类型对智能感知的影响不显著(M高互动=6.01,SD=0.57;M低互动=5.63,SD=1.29;F(1,56)=2.43,p=0.125);更为重要的是,任务类型与机器人外观拟人化的交互对智能感知的影响也不显著(p=0.185)。因此,实验材料的有效性再次得到验证。更为重要的是,排除了感知智能的替代解释。

(二)正式实验

实验一采用2(任务类型:高互动vs.低互动)组间×2(拟人化:高vs.低)组内混合实验设计。通过Credamo平台招募了150名参与者,排除注意力检测未通过的3份无效样本,最终有效样本为147份,其中女性85人(57.80%),平均年龄Mage=30.09(SD=7.59)岁。向所有被试支付2元作为实验报酬。

首先将被试随机分配到高交互组或低交互组,并让其设想自己外出旅游,来到一家酒店。在高交互组,服务机器人作为酒店前台为顾客办理入住,而在低交互组,服务机器人作为行李员为顾客搬运行李(详见表1)。同时,向被试呈现两类服务机器人(如图2),并询问被试更愿意选择哪一个机器人为自己服务。为避免图片出现顺序所带来的偏差,两张图片的呈现顺序是随机的。被试在做出选择后,评价在此过程中自己与酒店服务机器人的互动程度和新奇感(Guiry等,2006),“这种服务体验是不同寻常的/我之前从未有过这样的服务体验”(α=0.70),1代表“非常不同意”,7代表“非常同意”。并且被试分别判断服务机器人S-1000与服务机器人小鲁更像人类还是更像机器。最后,收集人口统计学信息并致谢。

(三)结果与讨论

1. 操控检验。单因素方差分析检验被试感知任务类型的互动程度,结果显示,服务机器人办理入住(vs.搬运行李)时,被试感知与机器人的互动程度更高(M高互动=5.53,SD=0.91;M低互动=4.10,SD=1.40;F(1,145)=55.21,p<0.001)。此外,99.30%的被试认为服务机器人小鲁更像人类,而98.60%的被试认为服务机器人S-1000更像机器。因此,任务类型和服务机器人拟人化操控成功。

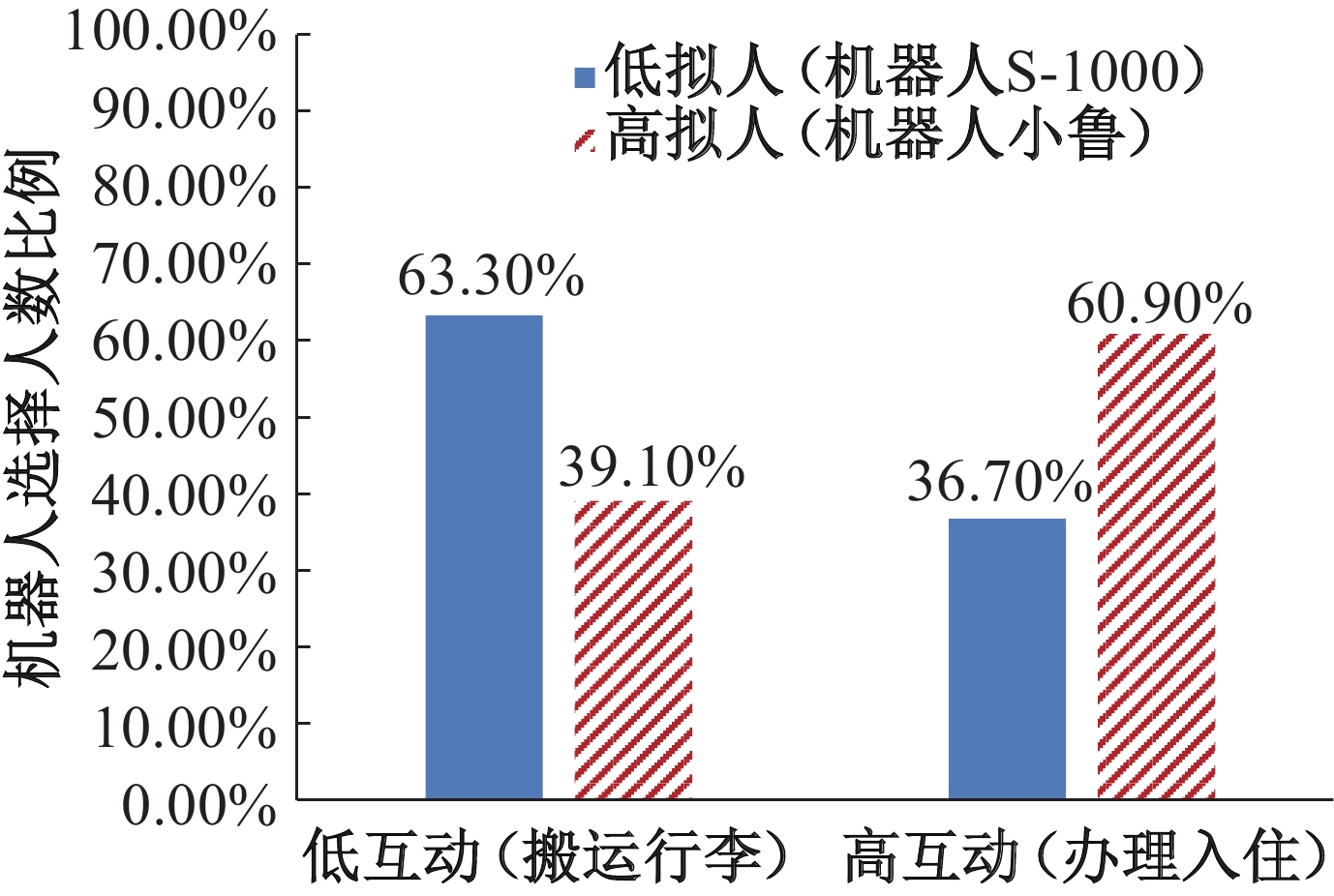

2. 服务机器人的选择。卡方检验表明,在低互动情境的人数比例(n=72)中,服务机器人S-1000高于服务机器人小鲁(63.30% vs. 39.10%),而在高互动情境的人数比例(n=75)中,服务机器人小鲁高于服务机器人S-1000(60.90% vs. 36.70%),person χ2=8.36,p=0.004,结果见图3。二元logistic回归分析进一步表明,任务类型对服务机器人选择具有显著影响,B=−0.990,S.E.=0.346,p=0.004,Exp(B)=0.371。此外,将人口统计学变量性别、年龄、月收入(学生为月消费)和学历等引入模型后,任务类型对服务机器人选择的影响仍然显著,B=−1.138,S.E.=0.371,p=0.002,Exp(B)=0.321。性别等人口统计学变量对服务机器人选择无显著影响(ps>0.1)。

|

| 资料来源:本文作者自制。 图 3 实验一中服务机器人选择的人数比例 |

实验一的结果表明,在搬运行李的低互动性任务情境下,被试更愿意选择低拟人化的服务机器人S-1000,但在办理入住的高互动性任务情境下,被试更愿意选择高拟人化的服务机器人小鲁而不是低拟人化的服务机器人S-1000。因此,实验一初步验证了假设H1,即假设H1a和H1b。

四、实验二实验二的主要目的是通过采用不同的实验场景和实验设计,再次验证不同任务类型下消费者对拟人化服务机器人的偏好,提高实验结果的稳健性。

(一)前测

本次前测开展了两项独立的实验,分别检验实验材料的有效性和验证任务类型与预期行为拟人化的关系。

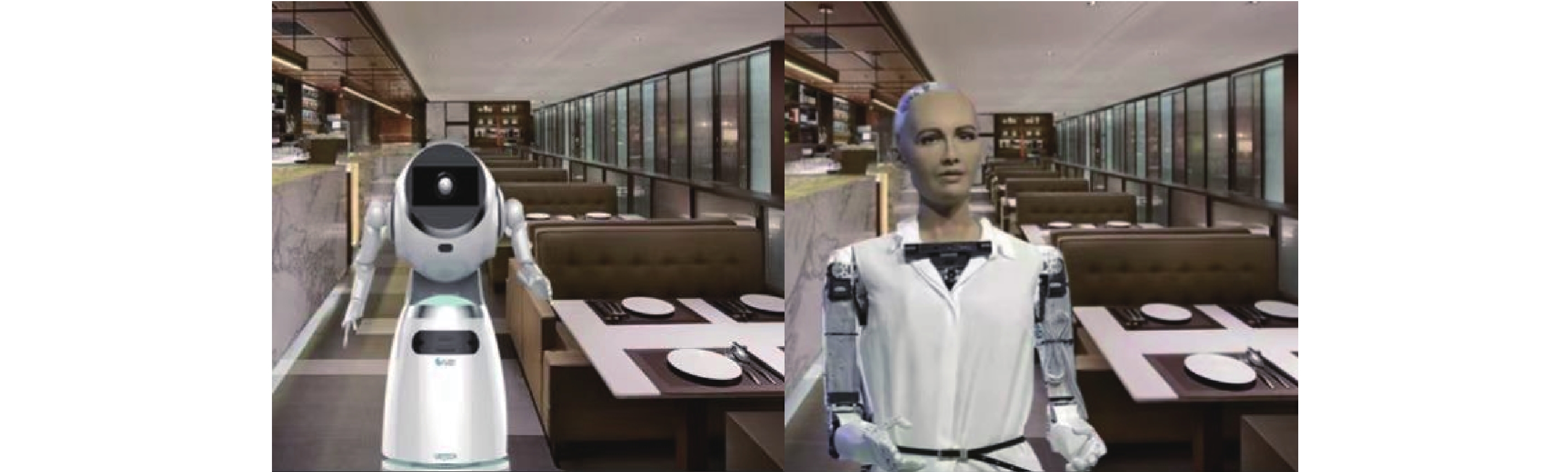

首先是检验实验材料有效性的前测实验。通过Credamo平台招募了80名被试参与前测,排除未完成注意力检测的无效样本后,得到有效样本74份,其中51.40%为女性,平均年龄Mage=31.19(SD=9.29)岁,并支付1元作为实验报酬。被试被要求完成两项独立不相关的任务。首先将被试随机分配到高(低)拟人组,要求他们在观看餐厅服务机器人的图片(如图4所示)后,评价服务机器人的拟人化程度(Mende等,2019),“这个服务机器人看起来像人类/像机器”(α=0.856)。随后,将被试重新随机分配到高(低)互动性任务组,在高(低)互动性任务组向被试描述餐厅服务员是怎样为顾客提供点餐(送餐)服务的(详见表2),并要求被试评价点餐(送餐)时,服务员与顾客的互动程度。所有题项都采用7点里克特量表,1代表“非常不同意/互动程度非常低”,7代表“非常同意/互动程度非常高”。

|

| 资料来源:本文作者自制。 图 4 低拟人化服务机器人ST-100(左)和高拟人化服务机器人小白(右) |

| 高互动(点餐服务) | 低互动(送餐服务) | |

| 任务类型 | 在点餐时,服务员除了记录菜品,还会主动询问顾客的口味偏好,并推荐特色菜肴和应季菜品 | 在送餐时,服务员只需及时且准确地将菜肴送到顾客面前,并祝顾客用餐愉快后便可离开 |

| 资料来源:本文作者自制。 | ||

结果显示,相比于低拟人化机器人,高拟人化机器人被认为更像人(M高拟人=3.71,SD=1.25;M低拟人=2.75,SD=1.23;t=−3.318,p=0.001),且被试的新奇感不存在显著差异(p=0.858)。此外,被试对点餐服务的互动程度感知显著高于送餐服务(M点餐=5.67,SD=1.33;M送餐=4.29,SD=1.83;t=−3.686,p<0.001)。因此,实验操控是成功的,拟人化机器人和任务类型的实验材料将被用于正式实验。

验证任务类型与预期行为拟人化关系的前测实验,通过Credamo平台招募了80名被试,其中47人(58.80%)为女性,平均年龄Mage=33.06(SD=8.13)岁,并支付1元作为实验报酬。采用单因素2水平(任务类型:高互动vs.低互动)组间设计。要求被试设想自己来到一家餐厅就餐,服务机器人为其提供点餐服务或送餐服务(详见表2),随后,被试报告在多大程度上认为服务机器人在此过程中表现出的行为很像人类/像机器(α=0.900),量表改编自Mende等(2019),1代表“非常不同意”,7代表“非常同意”。最后收集人口统计学信息并致谢。结果显示,相比于提供送餐服务,被试认为提供点餐服务的机器人会展现出更高水平的行为拟人化(M高互动=5.54,SD=0.87;M低互动=3.06,SD=1.31;F(1,78)=99.24,p<0.001)。由此可见,当机器人执行高互动性(vs.低互动性)任务时,个体期望机器人表现出更高水平的行为拟人化。

(二)正式实验

实验二采用2(拟人化:高vs.低)×2(任务类型:高互动vs.低互动)组间设计。通过Credamo平台另外招募了232名参与者,排除注意力检测题回答错误的无效问卷,最终获得有效样本221份(60.2%为女性),年龄Mage=29.49(SD=6.95)岁。向每名被试支付2元作为报酬。

被试被随机分配到四个实验情境中,拟人化机器人(如图4)与任务类型的材料(详见表2)来自前测。首先,要求被试设想自己来到一家新开的餐厅就餐,并且该餐厅的部分服务是由机器人提供的。在高拟人且高互动情境中,被试被告知餐厅服务员小白将为其提供点餐服务;在低拟人且低互动情境中,被试被告知服务机器人ST-100将为其提供送餐服务;在低拟人且高互动情境中,被试被告知服务机器人ST-100将为其提供点餐服务;而在高拟人且低互动情境中,被试则被告知服务员小白将为其提供送餐服务。随后,被试报告其偏好,即是否愿意接受该服务机器人,“我想要接触这个服务机器人”,1代表“非常不同意”,7代表“非常同意”。最后,操控检验机器人拟人化程度和任务类型互动程度(同前测),并收集人口统计学信息和致谢。

(三)结果与讨论

1. 操控检验。单因素方差分析分别检验被试感知的服务机器人拟人化程度和任务互动程度。高外观拟人化组(vs.低外观拟人化组)被试对机器人的拟人化感知更高(M高拟人=4.55,SD=1.76;M低拟人=2.87,SD=1.39;t=−7.846,p<0.001);高互动性任务组(vs.低互动性任务组)被试认为任务互动程度更高(M点餐=5.74,SD=0.89;M送餐=4.79,SD=1.44;t=−5.964,p< 0.001)。结果表明外观拟人化和任务类型的操控都是成功的。

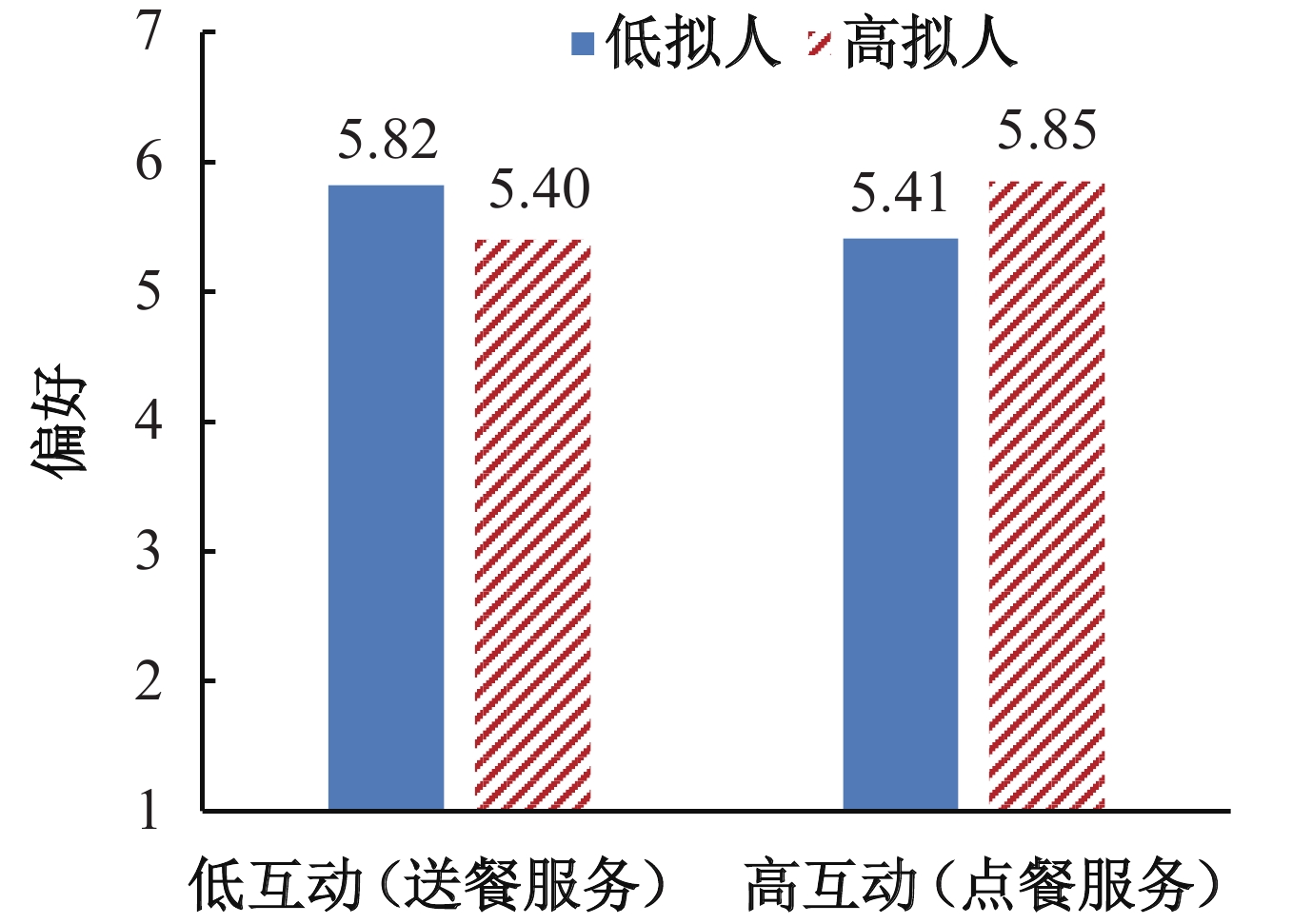

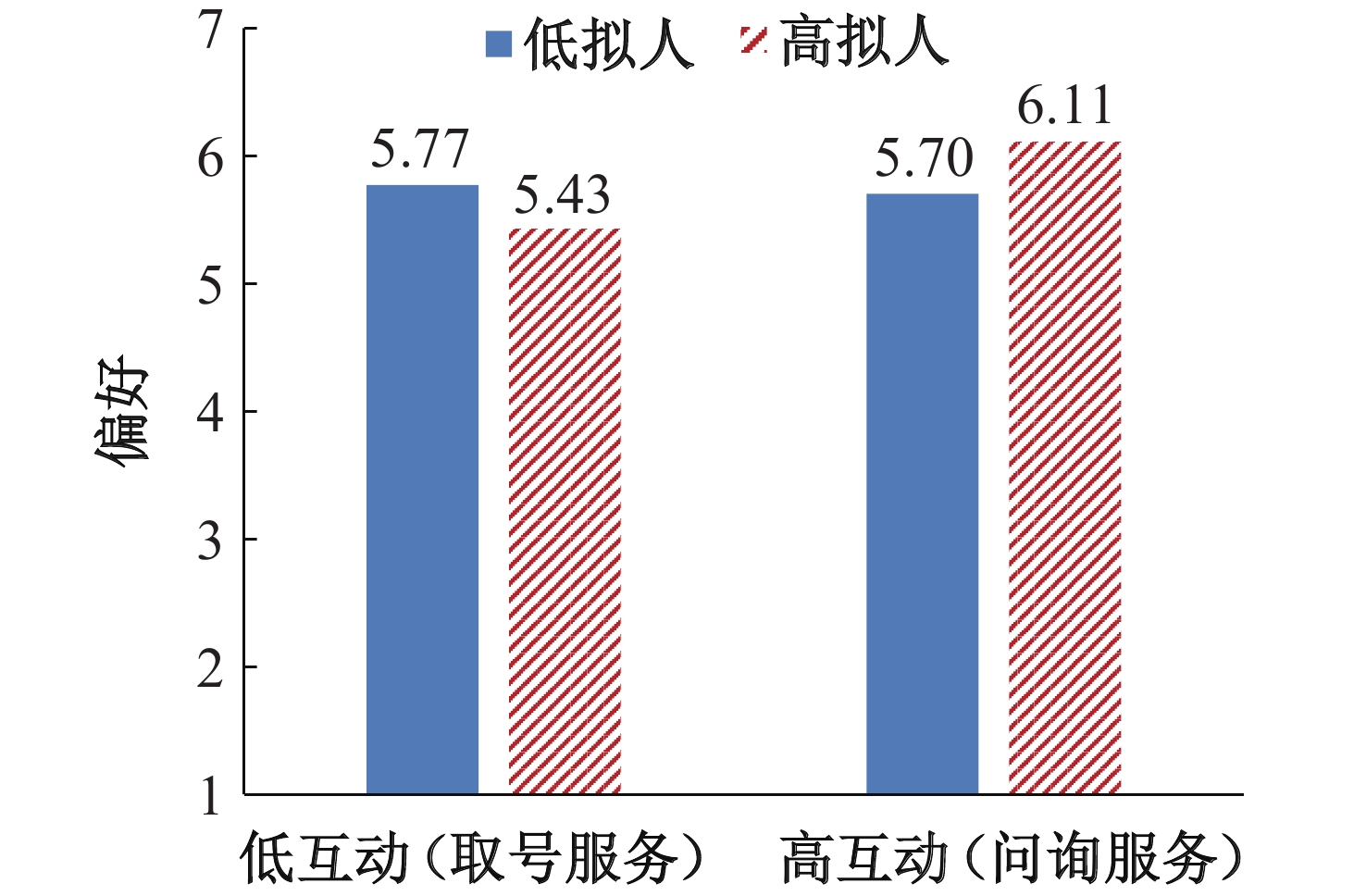

2. 偏好。以拟人化和任务类型为自变量,性别、年龄、学历、月收入(学生为月消费)和是否使用过AI为协变量,消费者接触意愿为因变量,使用多因素方差分析。结果表明,拟人化和任务类型的交互显著影响消费者对服务机器人的偏好(F(1,212)=8.39,p=0.004,partial η2=0.038),性别等协变量对消费者偏好的影响不显著(ps>0.2)。简单效应分析进一步可得,面对送餐服务,相对于高拟人化机器人,消费者更倾向于选择低拟人化机器人(M高拟人=5.40,SD=1.33;M低拟人=5.82,SD=1.02;F(1,212)=3.92,p=0.049,partial η2=0.018);面对点餐服务,相对于低拟人化机器人,消费者更倾向于选择高拟人化机器人(M高拟人=5.85,SD=1.13;M低拟人=5.41,SD=0.89;F(1,213)=4.63,p=0.033,partial η2=0.021)(见图5)。假设H1a和H1b得到支持。

|

| 资料来源:本文作者自制。 图 5 外观拟人化与任务类型对消费者偏好的影响 |

实验二验证了服务机器人拟人化与任务类型的交互对消费者偏好的显著影响。面对低互动性任务时,消费者更倾向于由低拟人化服务机器人提供服务;而面对高互动性任务时,消费者更倾向于由高拟人化服务机器人提供服务。但这一效应的内在机制并未得到检验,实验三将在验证主效应的基础上继续研究上述效应的中介机制。

五、实验三实验三的主要目的是检验信赖感和怪异感在不同任务类型下的中介作用,同时,也是采用不同服务场景再次验证假设H1a和H1b,提升其稳健性。

(一)前测

本次前测开展了两项独立的实验,分别检验实验材料的有效性和验证任务类型与预期行为拟人化的关系。

检验实验材料有效性的前测实验,为提高实验效度,选择电信运营商营业厅作为实验情境,重新采用了一组高或低拟人化机器人(如图6),并设计了一组代表高或低交互性任务的场景(详见表3)。通过Credamo平台另外招募了80名被试,平均年龄Mage=28.99(SD=7.886)岁,其中女性39名(48.80%)。实验流程、拟人化程度(α=0.803)和互动程度的测量同实验二中检验实验材料有效性的前测实验,区别在于在本次前测实验开始前要求被试填写自己最常用的电信运营商名称,并测量了被试看到机器人后的情绪(Blekher等,2020),共四个题项(α=0.761),1代表“伤心/心情差/烦躁/沮丧”,7代表“高兴/心情好/愉悦/快乐”。

|

| 资料来源:本文作者自制。 图 6 低拟人化服务机器人AI-100(左)和高拟人化服务机器人阿文(右) |

| 高互动(问询服务) | 低互动(取号服务) | |

| 任务类型 | 设想你正在中国移动(中国联通/中国电信)的一家营业厅,打算(重新)办理一个宽带套餐,该营业厅的服务机器人询问你用途并介绍几种可能适合你的套餐,你提出疑问时,它会非常耐心且详细地为你解答 | 设想你正在中国移动(中国联通/中国电信)的一家营业厅,打算(重新)办理一个宽带套餐,你通过点击该营业厅服务机器人的屏幕选择宽带套餐办理,服务机器人会生成排队号码,你领取号码后就可去等候区等待 |

| 资料来源:本文作者自制。 | ||

结果显示,相比于低拟人化机器人,高拟人化机器人被认为看起来更像人(M高拟人=3.63,SD=1.71;M低拟人=2.53,SD=1.59;t=−2.582,p=0.012)。而看到不同拟人化程度机器人时被试的情绪(p=0.998)不存在显著差异。最后,被试对问询服务的互动程度感知显著高于取号服务(M问询=5.63,SD=0.89;M取号=4.53,SD=1.46;t=−3.531,p=0.001)。因此,实验操控是成功的,拟人化机器人和任务类型将被用于实验三。

验证任务类型与预期行为拟人化关系的前测实验,通过Credamo平台招募了70名被试,其中39人(55.70%)为女性,平均年龄Mage=32.40(SD=6.36)岁,并支付1元作为实验报酬。采用单因素2水平(任务类型:高互动vs.低互动)组间设计。要求被试设想自己来到一家营业厅,服务机器人为其提供问询服务或取号服务(详见表3),随后,被试报告在多大程度上认为服务机器人在此过程中表现出的行为很像人类/像机器(α=0.928),改编自Mende等(2019),1代表“非常不同意”,7代表“非常同意”。最后收集人口统计学信息并致谢。结果显示,相比于提供取号服务的机器人,被试认为提供问询服务的机器人会展现出更高水平的行为拟人化(M高互动=5.19,SD=1.33;M低互动=3.36,SD=1.70;F(1,68)=24.97,p<0.001)。由此可见,机器人执行高互动性(vs.低互动性)任务时,个体期望机器人表现出更高水平的行为拟人化。

(二)正式实验

实验采用2(拟人化:高vs.低)×2(任务类型:高互动vs.低互动)组间设计,借助Credamo平台另外招募了220名参与者,排除甄选题回答错误的无效问卷,最终获得有效样本205份(63.9%为女性),年龄Mage=29.46(SD=6.765)岁。向每名被试支付2元作为报酬。

被试被随机分配到四个实验情境中,拟人化机器人(如图6)与任务类型的材料(详见表3)来自本次实验的前测。首先被试填写自己最常用的电信运营商,并设想自己在该运营商的某个线下营业厅办理业务。在高拟人且高互动情境中,被试被告知工作人员阿文将为其提供问询服务;在低拟人且低互动情境中,被试被告知服务机器人AI-100将为其提供取号服务;在低拟人且高互动情境中,被试被告知服务机器人AI-100将为其提供问询服务;而在高拟人且低互动情境中,被试则被告知工作人员阿文将为其提供取号服务。要求被试报告对机器人的偏好,借鉴Stroessner和Benitez(2019)的两题项量表(α=0.701),“我很喜欢这个服务机器人/与这个服务机器人接触,我会感到很高兴”,1代表“非常不同意”,7代表“非常同意”。紧接着,测量被试的信赖感(Gong,2008)和怪异感(Mende等,2019),其中五个题项测量信赖感(α=0.827),1代表“不能信任的/不可靠的/不真诚的/不诚实的/不可信赖的”,7代表“值得信任的/可靠的/真诚的/诚实的/可信赖的”;三个题项测量怪异感(α=0.744),“这个服务机器人看起来令人毛骨悚然/很怪异/不自然”,1代表“非常不同意”,7代表“非常不同意”。最后报告机器人拟人化程度(α=0.882)和任务互动程度,同前测,并收集人口统计学信息和致谢。

(三)结果与讨论

1. 操控检验。使用单因素方差分析对被试感知的服务机器人拟人化程度和任务互动程度进行测量。高外观拟人化组(vs.低外观拟人化组)被试对机器人的拟人化感知更高(M高拟人=3.72,SD=1.60;M低拟人=2.56,SD=1.09;t=−6.17,p<0.001);高互动性任务组(vs.低互动性任务组)被试认为任务互动程度更高(M问询=5.76,SD=0.72;M取号=4.83,SD=1.14;t=−6.87,p<0.001)。结果表明外观拟人化和任务类型的操控都是有效的。

2. 偏好。检验拟人化和任务类型的交互对消费者偏好的影响。以拟人化和任务类型为自变量,性别、年龄、学历、月收入和是否使用过AI为协变量,消费者偏好为因变量,使用多因素方差分析。结果表明,拟人化和任务类型的交互显著影响消费者对服务机器人的偏好(F(1,196)=10.642,p=0.001,partial η2=0.052)。且简单效应分析表明,面对取号服务时,相对于高拟人化机器人,消费者更倾向于选择低拟人化机器人(M高拟人=5.43,SD=0.111;M低拟人=5.77,SD=0.123;F(1,196)=4.192,p=0.042,partial η2=0.021);而面对问询服务时,相对于低拟人化机器人,消费者更倾向于选择高拟人化机器人(M高拟人=6.11,SD=0.108;M低拟人=5.70,SD=0.111;F(1,196)=6.742,p=0.010,partial η2=0.033)(见图7)。综上,低拟人化服务机器人执行低互动性任务、高拟人化服务机器人执行高互动性任务更能激发消费者更高的偏好。结果与实验二相同,假设H1a和H1b再次得到支持。

|

| 资料来源:本文作者自制。 图 7 外观拟人化与任务类型对消费者偏好的影响 |

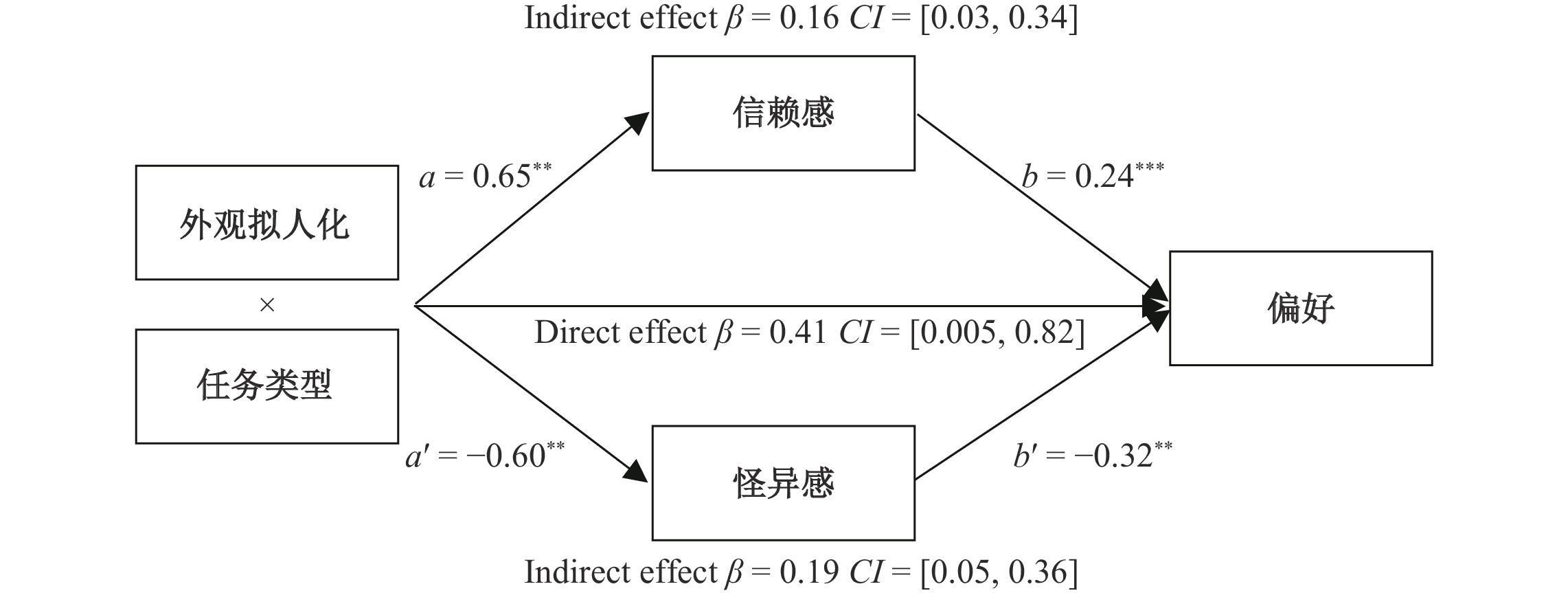

3. 信赖感和怪异感的中介效应。借鉴Hayes和Rockwood(2020)提出的中介分析方法,使用PROCESS 3.0插件,选择model 8、

|

| 注:**代表0.001<p<0.05,***代表p<0.001。 资料来源:本文作者自制。 图 8 信赖感和怪异感的中介效应 |

拟人化与任务类型的交互对怪异感具有显著作用(β=−0.60;95% CI=−1.01~−0.20,不包含0);同时,当怪异感作为中介变量纳入模型时,在低互动性任务下怪异感中介了拟人化程度对消费者偏好提高的影响(β=−0.12;95% CI=−0.25~−0.02,不包含0),但在高互动性任务下怪异感在拟人化程度对消费者偏好的影响中没发挥中介作用(β=0.07;95% CI=−0.01~0.17,包含0)。整体而言,怪异感的中介作用显著(β=0.19;95% CI=0.05~0.36,不包含0),见图8。

实验三的结果表明,信赖感和怪异感在拟人化和任务类型的交互对消费者偏好的影响中起中介作用。信赖感的中介作用主要体现在高互动性任务与高拟人化机器人相匹配时,因为对于执行高互动性任务的机器人,顾客对其能力和社交互动的要求往往更高,高拟人化能够提高社交感知以及顾客对机器人能力的信赖。怪异感的中介作用主要体现在低互动性任务和低拟人化机器人相匹配时,因为对于执行低互动性任务的机器人,消费者认为机器人只需机械地重复相对简单且固定的动作,高外观拟人化机器人在执行此类任务时可能使消费者认为机器人将要表现出的行为与其外表不匹配,进而导致过度拟人化,引发怪异感,因此消费者倾向于低外观拟人化机器人执行低互动性任务以减少这种怪异感。

六、研究结果与讨论(一)研究结果

本研究通过三项实验,探究了服务机器人外观拟人化与任务类型对消费者接触服务机器人意愿的交互影响,即在不同互动程度的任务条件下,对比了服务机器人外观拟人化程度对消费者偏好的影响。实验一表明,在高互动性服务(办理酒店入住)条件下,被试更倾向于选择外观拟人化程度高的服务机器人;而在低互动性服务(搬运行李)条件下,被试更倾向于选择外观拟人化程度低的服务机器人。实验二基于餐厅场景将点餐表征为高互动性任务,将送餐表征为低互动性任务。结果显示,服务机器人拟人化程度和任务类型的交互对消费者偏好有显著影响。具体而言,面对低互动性任务,消费者更偏好外观拟人化程度低的服务机器人;面对高互动性任务,消费者更喜欢外观拟人化程度高的服务机器人。实验三在电信运营商营业厅场景中将业务问询服务和排队取号服务分别作为高互动性和低互动性任务,进一步探究信赖感和怪异感的中介作用。结果表明,在低互动性任务中,怪异感中介了服务机器人外观拟人化对消费者偏好的影响;而在高互动性任务中,信赖感中介了服务机器人外观拟人化对消费者偏好的影响。

(二)理论贡献

本研究探讨了服务机器人外观拟人化与任务类型对消费者接触服务机器人意愿的交互作用,主要有以下三个方面的理论贡献:

首先,本研究丰富和拓展了机器人拟人化相关研究领域,验证了机器人外观和预期行为的拟人化不一致也会导致个体对机器人的抵触。机器人拟人化相关研究认为机器人不受欢迎的主要原因之一是外观拟人化过度引发“恐怖谷”效应,使人们对机器人的反应由积极转变为消极(Tinwell等,2011;Gray和Wegner,2012)。虽然在技术的加持下,服务机器人的外观拟人化程度不断提升,人们对机器人的反应极有可能摆脱“恐怖谷”效应(Mori等,2012),但是,在外观拟人化达到何种水平会诱发“恐怖谷”效应尚无明确衡量指标的现状下,一味提升机器人外观拟人化程度以期到达摆脱“恐怖谷”效应的拐点,似乎是缺乏理论指导的和不明智的。本研究表明,在机器人维持已有外观拟人化程度的基础上,也有可能避免引起不适并提升消费者的信赖感。具体而言,外观拟人化程度高的机器人执行高互动性(vs.低互动性)服务任务更有可能提升消费者的信赖感。因为机器人执行高互动性(vs.低互动性)服务任务时,个体预期机器人表现出的行为更像人,而对于外观高拟人化的机器人,人们认为其外形拟人化程度与预期的行为拟人化程度相一致。

其次,本研究比较了在互动要求不同的服务下,消费者对高、低拟人化服务机器人的偏好,是对拟人化服务机器人相关研究的重要补充。以往研究虽然证实了消费者在与服务机器人互动的过程中,其认知、心理和行为可能发生重大变化(杜建刚等,2022),但却忽略了互动过程本身固有的特征。根据机器人需要执行的任务,程序员提前设定机器人的行为,也就是说任务的互动水平很可能决定着机器人的行为。因此,本研究立足于互动过程差异,发现当所要求的互动水平存在不同时,消费者对拟人化服务机器人的偏好也存在显著差异。此外,以往研究将机器人所执行的任务主要划分为有形和无形任务(Wirtz和Lovelock,2016)、相对主观和相对客观任务(Castelo等,2019)、认知分析型和情感社交型任务(Wirtz等,2018),以及数值型和非数值型数据处理任务(Davenport等,2020),并探讨了机器人更加擅长执行哪一类任务。而本研究基于服务机器人与消费者接触和提供服务时所需要的互动水平,将任务区分为高互动性与低互动性服务任务,并提出和验证了根据服务的互动水平差异,消费者对高拟人化机器人服务存在着明显的偏好差异。

最后,本研究拓展了在智能化和机器人化服务情境中对信赖感和怪异感的探索,并在一定程度上回答了消费者对拟人化机器人态度出现两个极端的内因。以往一些研究认为拟人化设计有助于提升机器人的可信赖感,是建立消费者与机器人信赖关系的重要方式(Duffy,2003;Qin等,2023;So等,2024)。然而,另一些研究则认为机器人的拟人化可能带来负面的影响。Kim等(2019)发现,消费者对拟人化程度较高的机器人感到不适。消费者在与类人服务机器人交互的过程中会感到人类身份受威胁(Alsaad,2023),并产生一系列的补偿行为(Mende等,2019)。拟人化机器人也会引发员工的工作不安全感(Wang等,2023),引起更多的消极反应(Tojib等,2023)。而本研究发现,服务机器人所执行的任务类型在一定程度上可以调和这种相对矛盾的观点。具体而言,在互动需求低的服务中,消费者认为高(vs.低)外观拟人化机器人更加怪异,进而避免与之接触;反之,在互动需求高的服务中,消费者认为高(vs.低)外观拟人化机器人更值得信赖,更愿意与之接触。

(三)管理启示

本研究对于企业何时引入外观拟人化高或低的服务机器人具有借鉴作用。本研究结果显示,在互动水平较低的服务情境下,消费者更愿意接触外观拟人化低(vs.高)的服务机器人。相反,消费者更信赖高(vs.低)外观拟人化的机器人提供的高互动服务。因此,企业在采购服务机器人时,要重点关注机器人的外观拟人化与它所执行任务所要求的互动水平是否匹配。对于互动水平较低的工作岗位(如送餐、排队取号等服务),企业可以采购低外观拟人化的机器人来为消费者提供服务;而对于互动水平较高的工作岗位(如点餐、业务咨询等服务),企业应尽量使用高外观拟人化的机器人。

本研究对于企业避免消费者在与服务机器人互动的过程中产生怪异感并提升消费者对服务机器人的信赖感具有一定的启发价值。本研究表明,低(vs.高)外观拟人化的机器人提供高互动要求的服务时,消费者对服务机器人的信赖感较低,而高(vs.低)外观拟人化的机器人提供低互动要求的服务时,消费者会认为这个服务机器人十分怪异。加之,机器人进入服务领域必然取代某些工作岗位并可能改变服务人员的工作职责(Wirtz等,2018)。因此,已经采用了服务机器人的企业可以基于机器人的外形(高拟人或低拟人)重新规划工作岗位以及岗位职责,实现服务机器人与工作岗位的匹配,进而降低消费者的怪异感并获得其信赖感,以提升企业绩效。

(四)局限和展望

本研究还存在一些局限和不足,可以在未来的研究中进一步拓展。首先,本文没有探讨边界条件,未来研究可以在本文的基础上进一步拓展,尤其是关注消费者相关因素。以往研究表明社会阶层(张仪和王永贵,2022;Yao等,2022)、内隐人格倾向(王海忠等,2021)等消费者个体因素在消费者与服务机器人接触的过程中都可能产生影响。因此,未来研究可以探索消费者相关因素(如权力感、孤独感、社交需求等)对本研究结论的调节效应。

其次,本研究所选用的实验场景(即酒店、餐厅和电信运营商营业厅)具有一定的局限性。未来研究可能需要选取更多的不同服务场所作为实验场景,来检验拟人化与任务类型的交互作用。此外,未来研究还可以考虑在条件允许的情况下,通过实地实验和二手数据等方式来进一步验证本研究结论的稳健性。

| [1] | 杜建刚, 赵欢, 苏九如, 等. 服务智能化下的顾客行为: 研究述评与展望[J]. 外国经济与管理, 2022, 44(3): 19–35. |

| [2] | 黄敏学, 吕林祥, 毛文萱. 服务机器人拟人化策略与消费任务类型的交互影响——双重信任视角[J]. 营销科学学报, 2023, 3(2): 115–136. |

| [3] | 蒋玉石, 李倩, 刘好, 等. 任是“无情”也动人? AI机器人服务失败后道歉主体对消费者宽恕的影响[J/OL]. 南开管理评论, http://kns.cnki.net/kcms/detail/ 12.1288.F.20230814.1651.002.html, 2023-08-14. |

| [4] | 雷怡, 夏琦, 莫志凤, 等. 面孔可爱度和客观熟悉度对婴儿面孔注意偏向效应的影响[J]. 心理学报, 2020, 52(7): 811–822. |

| [5] | 林子筠, 吴琼琳, 才凤艳. 营销领域人工智能研究综述[J]. 外国经济与管理, 2021, 43(3): 89–106. |

| [6] | 刘欣, 谢礼珊, 黎冬梅. 旅游服务机器人拟人化对顾客价值共创意愿影响研究[J]. 旅游学刊, 2021, 36(6): 13–26. |

| [7] | 王海忠, 谢涛, 詹纯玉. 服务失败情境下智能客服化身拟人化的负面影响: 厌恶感的中介机制[J]. 南开管理评论, 2021, 24(4): 194–204. |

| [8] | 吴继飞, 于洪彦, 朱翊敏, 等. 人工智能推荐对消费者采纳意愿的影响[J]. 管理科学, 2020, 33(5): 29–43. |

| [9] | 许丽颖, 喻丰. 机器人接受度的影响因素[J]. 科学通报, 2020, 65(6): 496–510. |

| [10] | 张仪, 王永贵. 服务机器人拟人化对消费者使用意愿的影响机理研究——社会阶层的调节作用[J]. 外国经济与管理, 2022, 44(3): 3–18. |

| [11] | Aggarwal P, Mcgill A L. When brands seem human, do humans act like brands? Automatic behavioral priming effects of brand anthropomorphism[J]. Journal of Consumer Research, 2012, 39(2): 307–323. |

| [12] | Alsaad A. The dual effect of anthropomorphism on customers’ decisions to use artificial intelligence devices in hotel services[J]. Journal of Hospitality Marketing & Management, 2023, 32(8): 1048–1076. |

| [13] | Ashfaq M, Yun J, Yu S B, et al. I, chatbot: Modeling the determinants of users’ satisfaction and continuance intention of AI-powered service agents[J]. Telematics and Informatics, 2020, 54: 101473. |

| [14] | Blekher M, Danziger S, Grinstein A. Salient volunteering behavior increases monetary risk-taking[J]. Journal of Consumer Psychology, 2020, 30(3): 525–533. |

| [15] | Broadbent E, Stafford R, MacDonald B. Acceptance of healthcare robots for the older population: Review and future directions[J]. International Journal of Social Robotics, 2009, 1(4): 319–330. |

| [16] | Cabibihan J J, Joshi D, Srinivasa Y M, et al. Illusory sense of human touch from a warm and soft artificial hand[J]. IEEE Transactions on Neural Systems and Rehabilitation Engineering, 2015, 23(3): 517–527. |

| [17] | Castelo N, Bos M W, Lehmann D R. Task-dependent algorithm aversion[J]. Journal of Marketing Research, 2019, 56(5): 809–825. |

| [18] | Chattopadhyay D, MacDorman K F. Familiar faces rendered strange: Why inconsistent realism drives characters into the uncanny valley[J]. Journal of Vision, 2016, 16(11): 7. |

| [19] | Chi R, Zhang J Y, Pan M Q. The effect of anthropomorphic competence-warmth congruence of service robots on recommendation intention[J]. Current Psychology, 2024, 43(7): 6570–6583. |

| [20] | Choi K, Wang Y, Sparks B. Travel app users’ continued use intentions: It’s a matter of value and trust[J]. Journal of Travel & Tourism Marketing, 2019, 36(1): 131–143. |

| [21] | Dabholkar P A, Bagozzi R P. An attitudinal model of technology-based self-service: Moderating effects of consumer traits and situational factors[J]. Journal of the Academy of Marketing Science, 2002, 30(3): 184–201. |

| [22] | Davenport T, Guha A, Grewal D, et al. How artificial intelligence will change the future of marketing[J]. Journal of the Academy of Marketing Science, 2020, 48(1): 24–42. |

| [23] | Duffy B R. Anthropomorphism and the social robot[J]. Robotics and Autonomous Systems, 2003, 42(3-4): 177–190. |

| [24] | Goetz J, Kiesler S, Powers A. Matching robot appearance and behavior to tasks to improve human-robot cooperation[A]. The 12th IEEE international workshop on robot and human interactive communication[C]. Millbrae: IEEE, 2003. |

| [25] | Gong L. How social is social responses to computers? The function of the degree of anthropomorphism in computer representations[J]. Computers in Human Behavior, 2008, 24(4): 1494–1509. |

| [26] | Gray H M, Gray K, Wegner D M. Dimensions of mind perception[J]. Science, 2007, 315(5812): 619. |

| [27] | Gray K, Wegner D M. Feeling robots and human zombies: Mind perception and the uncanny valley[J]. Cognition, 2012, 125(1): 125–130. |

| [28] | Guiry M, Mägi A W, Lutz R J. Defining and measuring recreational shopper identity[J]. Journal of the Academy of Marketing Science, 2006, 34(1): 74–83. |

| [29] | Hayes A F, Rockwood N J. Conditional process analysis: Concepts, computation, and advances in the modeling of the contingencies of mechanisms[J]. American Behavioral Scientist, 2020, 64(1): 19–54. |

| [30] | Hoff K A, Bashir M. Trust in automation: Integrating empirical evidence on factors that influence trust[J]. Human Factors: The Journal of the Human Factors and Ergonomics Society, 2015, 57(3): 407–434. |

| [31] | Hur J D, Koo M, Hofmann W. When temptations come alive: How anthropomorphism undermines self-control[J]. Journal of Consumer Research, 2015, 42(2): 340–358. |

| [32] | Kätsyri J, Förger K, Mäkäräinen M, et al. A review of empirical evidence on different uncanny valley hypotheses: Support for perceptual mismatch as one road to the valley of eeriness[J]. Frontiers in Psychology, 2015, 6: 390. |

| [33] | Kessler T, Dutta C N, Marlowe T A, et al. A comparison of trust measures in human-robot interaction scenarios[A]. AHFE international applied human factors and ergonomics conference (7th annual)[C]. Orlando: University of Central Florida, 2016. |

| [34] | Kiesler S, Sproull L, Waters K. A prisoner’s dilemma experiment on cooperation with people and human-like computers[J]. Journal of Personality and Social Psychology, 1996, 70(1): 47–65. |

| [35] | Kim S, Chen R P, Zhang K. Anthropomorphized helpers undermine autonomy and enjoyment in computer games[J]. Journal of Consumer Research, 2016, 43(2): 282–302. |

| [36] | Kim S Y, Schmitt B H, Thalmann N M. Eliza in the uncanny valley: Anthropomorphizing consumer robots increases their perceived warmth but decreases liking[J]. Marketing Letters, 2019, 30(1): 1–12. |

| [37] | Lee I. Service robots: A systematic literature review[J]. Electronics, 2021, 10(21): 2658. |

| [38] | Lee N, Kim J, Kim E, et al. The influence of politeness behavior on user compliance with social robots in a healthcare service setting[J]. International Journal of Social Robotics, 2017, 9(5): 727–743. |

| [39] | Lee J G, Kim K J, Lee S, et al. Can autonomous vehicles be safe and trustworthy? Effects of appearance and autonomy of unmanned driving systems[J]. International Journal of Human-Computer Interaction, 2015, 31(10): 682–691. |

| [40] | Lee H R, Šabanović S. Culturally variable preferences for robot design and use in South Korea, Turkey, and the United States[A]. Proceedings of the 2014 9th ACM/IEEE international conference on human-robot interaction[C]. Bielefeld: IEEE, 2014. |

| [41] | MacDorman K F, Chattopadhyay D. Categorization-based stranger avoidance does not explain the uncanny valley effect[J]. Cognition, 2017, 161: 132–135. |

| [42] | Mende M, Scott M L, Van Doorn J, et al. Service robots rising: How humanoid robots influence service experiences and elicit compensatory consumer responses[J]. Journal of Marketing Research, 2019, 56(4): 535–556. |

| [43] | Miao F, Kozlenkova I V, Wang H Z, et al. An emerging theory of avatar marketing[J]. Journal of Marketing, 2022, 86(1): 67–90. |

| [44] | Mori M, MacDorman K F, Kageki N. The uncanny valley[J]. IEEE Robotics & Automation Magazine, 2012, 19(2): 98–100. |

| [45] | Mulcahy R F, Riedel A, Keating B, et al. Avoiding excessive AI service agent anthropomorphism: Examining its role in delivering bad news[J]. Journal of Service Theory and Practice, 2024, 34(1): 98–126. |

| [46] | Nass C, Moon Y. Machines and mindlessness: Social responses to computers[J]. Journal of Social Issues, 2000, 56(1): 81–103. |

| [47] | Nguyen M, Casper Ferm L E, Quach S, et al. Chatbots in frontline services and customer experience: An anthropomorphism perspective[J]. Psychology & Marketing, 2023, 40(11): 2201–2225. |

| [48] | Pelau C, Dabija D C, Ene I. What makes an AI device human-like? The role of interaction quality, empathy and perceived psychological anthropomorphic characteristics in the acceptance of artificial intelligence in the service industry[J]. Computers in Human Behavior, 2021, 122: 106855. |

| [49] | Premathilake G W, Li H X. Users’ responses to humanoid social robots: A social response view[J]. Telematics and Informatics, 2024, 91: 102146. |

| [50] | Qin M, Li S Q, Zhu W, et al. Trust in service robot: The role of appearance anthropomorphism[J]. Current Issues in Tourism, 2023, DOI: 10.1080/13683500.2023.2295923. |

| [51] | Sääksjärvi M, Hellén K. How designers and marketers can work together to support consumers’ happiness[J]. International Journal of Design, 2013, 7(3): 33–44. |

| [52] | Saygin A P, Chaminade T, Ishiguro H, et al. The thing that should not be: Predictive coding and the uncanny valley in perceiving human and humanoid robot actions[J]. Social Cognitive and Affective Neuroscience, 2012, 7(4): 413–422. |

| [53] | Shechtman N, Horowitz L M. Interpersonal and noninterpersonal interactions, interpersonal motives, and the effect of frustrated motives[J]. Personality and Social Psychology Bulletin, 2006, 32(8): 1126–1139. |

| [54] | So K K F, Kim H, Liu S Q, et al. Service robots: The dynamic effects of anthropomorphism and functional perceptions on consumers’ responses[J]. European Journal of Marketing, 2024, 58(1): 1–32. |

| [55] | Song X X, Li Y P, Leung X Y, et al. Service robots and hotel guests’ perceptions: Anthropomorphism and stereotypes[J]. Tourism Review, 2024, 79(2): 505–522. |

| [56] | Stratistics Market Research Consulting. Service robotics[R/OL]. https://www.marketresearch.com/Global-Industry-Analysts-v1039/Service-Robotics, 2024-07-11. |

| [57] | Stroessner S J, Benitez J. The social perception of humanoid and non-humanoid robots: Effects of gendered and machinelike features[J]. International Journal of Social Robotics, 2019, 11(2): 305–315. |

| [58] | Tian M, Yan J R, Li X T. Anthropomorphism of service-oriented AI and customers’ propensity for value co-creation[J]. Marketing Intelligence & Planning, 2024, DOI: 10.1108/mip-08-2023-0388. |

| [59] | Tinwell A, Grimshaw M, Nabi D A, et al. Facial expression of emotion and perception of the uncanny valley in virtual characters[J]. Computers in Human Behavior, 2011, 27(2): 741–749. |

| [60] | Tojib D, Sujan R, Ma J Z, et al. How does service robot anthropomorphism affect human co-workers?[J]. Journal of Service Management, 2023, 34(4): 750–769. |

| [61] | Wang P X, Kim S, Kim M. Robot anthropomorphism and job insecurity: The role of social comparison[J]. Journal of Business Research, 2023, 164: 114003. |

| [62] | Waytz A, Epley N, Cacioppo J T. Social cognition unbound: Insights into anthropomorphism and dehumanization[J]. Current Directions in Psychological Science, 2010, 19(1): 58–62. |

| [63] | Wirtz J, Lovelock C. Services marketing: People, technology, strategy[M]. 8th ed. Hackensack, NJ: World Scientific Publishing Company, 2016. |

| [64] | Wirtz J, Patterson P G, Kunz W H, et al. Brave new world: Service robots in the frontline[J]. Journal of Service Management, 2018, 29(5): 907–931. |

| [65] | Xie Y G, Zhu K Y, Zhou P Y, et al. How does anthropomorphism improve human-AI interaction satisfaction: A dual-path model[J]. Computers in Human Behavior, 2023, 148: 107878. |

| [66] | Yao Q, Wu Z J, Zhou W K. The impact of social class and service type on preference for AI service robots[J]. International Journal of Emerging Markets, 2022, 17(4): 1049–1066. |