2024第46卷第6期

“当我们思考机器人时,我们就是在思考人类的未来……要了解人类的未来,就必须了解人与机器人的关系,尤其是情感关系……我们向机器人索取什么,就代表我们需要什么。”

——雪莉·特克尔《群体性孤独》

一、引 言随着机器人和人工智能技术的日趋成熟,各式各样的智能社交机器人开始走进消费者的生活。区别于传统概念上的机器人,智能社交机器人是人们赋予其类人人格并能与之进行有效互动和沟通的机器人(Venture和Kuli,2019)。它们一般集成了计算机控制系统和人工智能技术,具有一定的感知和交流能力,往往带有表情显示器,并具有类人或类动物的外形或虚拟形象,既包括服务机器人(如Pepper)、智能语音助手(如Siri、小爱同学)、智能宠物(如阿尔法机器狗、猫尾机器人Petit Qoobo、企鹅型宠物机器人Lovot)、智能陪伴机器人(如优必选的Welli、美的的小惟、小米的小丹)等有形实体,也包括虚拟聊天机器人(如Replika)。除了解答问题、聊天解闷、游戏娱乐等满足人们信息和社交需求的基本功能,有的智能社交机器人还能做出身体和情绪反应(如振动、摇尾巴、发出撒娇的声音、做出讨好的表情等),给人们带来情感抚慰和陪伴感(Ramadan等,2021),甚至使人们对其形成情感依恋(Björling等,2020),进而改善儿童、独居青年、空巢老人以及特殊群体的情绪健康,提高他们的生活质量和幸福感(Lorenz等,2016)。

现代社会的快节奏、繁重的生活压力以及智能手机的过度使用都导致了人际关系疏远,使人们普遍产生一定程度的孤独感和焦虑(雪莉•特克尔,2014)。尤其对于那些独生子女儿童、单身青年和空巢老人来说,他们的社交需求难以被充分满足,面临着社交隔离和孤独感的严重困扰(王美莹等,2020)。而长期处于孤独状态不仅会对人体免疫系统造成破坏,提高人们患上高血压、睡眠障碍、阿尔兹海默症和心血管类疾病的概率,还会降低人们的幸福感,导致焦虑、暴躁、抑郁等心理疾病(闫志民等,2014;Leigh-Hunt等,2017)。因此,在缺乏家人、朋友和宠物陪伴以及养老护理人员严重短缺的情况下,智能社交机器人未来在日常陪护、情感陪伴和情感抚慰方面将发挥重要的补充作用。

近年来,消费者与智能社交机器人的人机情感关系成为消费心理、信息科学和机器人工程等多学科交叉的前沿热点话题(Novak和Hoffman,2019;Liu-Thompkins等,2022),也是人工智能消费者行为研究的重要分支(林子筠等,2021;朱国玮等,2021;杜建刚等,2022)。学者们对人机情感关系的主要类型(Nomura和Kanda,2016;Ramadan等,2021;Liebers和Schramm,2017;Björling等,2020;Song等,2022)、形成机制(Seo等,2018;Lee等,2017;Zhang和Rau,2023;Kim等,2013;Singh,2022)和影响后果(Lorenz等,2016;Kim等,2022;Hernandez-Ortega和Ferreira,2021;Law等,2022)等问题开展了大量研究,取得了丰硕的研究成果。然而,现有研究较为零散和碎片化,不利于学者们把握该领域的研究现状和发展趋势。而且,已有研究的样本和数据主要来自国外,虽然国内学者对人工智能消费行为多有关注,但聚焦于人机情感关系的研究还极为稀缺(沈鹏熠等,2023)。

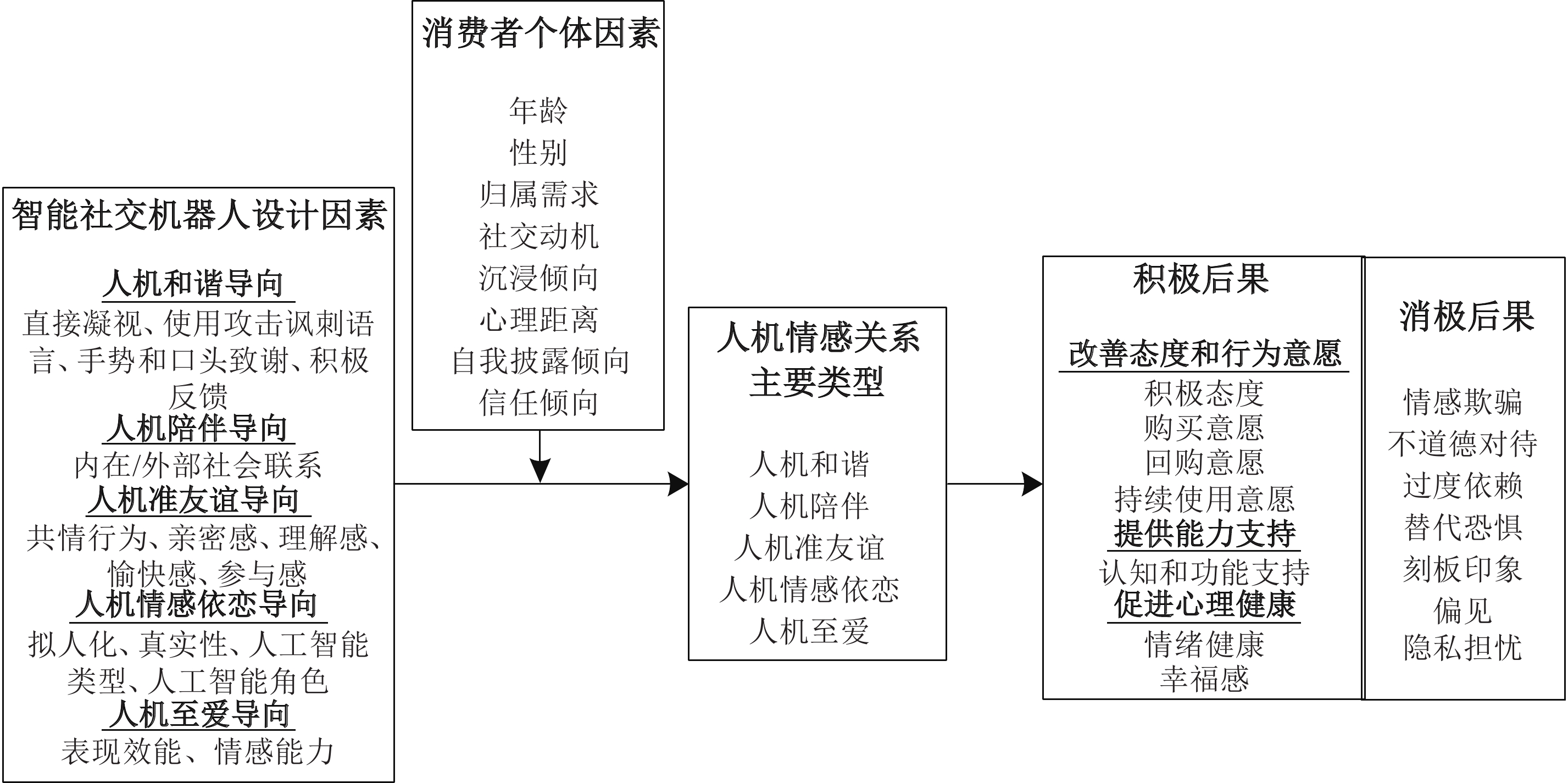

因此,本文旨在较为系统地梳理国内外有关人机情感关系的研究,从关系类型、形成机制和影响后果三个方面总结出人机情感关系研究的现有理论框架并指出未来研究方向,以期全景式呈现这一领域的研究现状和脉络,启发学者们对该领域的进一步研究。同时,本文也将为人工智能企业选择合适的目标群体、开展情感导向的智能社交机器人设计以及政府制定符合伦理道德的行业规范提供理论指导与实践启示,最终使消费者在人工智能时代更好地与智能社交机器人这一“新物种”共处,与之建立有意义的、健康的、符合伦理的人机情感关系,从而提高消费者幸福感。

二、人机情感关系的主要类型近年来,学者们致力于研究和揭示人机情感关系的性质和程度,发现消费者在不同情境下与智能社交机器人会形成人机和谐、陪伴、准友谊、情感依恋和至爱等多种不同类型的情感关系。

(一)人机和谐(rapport)

在早期阶段,人形社交机器人的外观设计还非常粗糙。当人们看到这些长相奇特、钢筋铁骨的“异类”时难免会感到十分陌生,心生恐惧。为了使人们更愿意接受社交机器人并与之互动和合作,研究者发现改进机器人的语言风格和行为举止有利于消费者与之建立类似人与人之间的和谐关系,即一种相互感兴趣、愿意沟通和融洽相处的友好关系(Wilson等,2017;Seo等,2018)。在这种关系模式下,人们能够体验到双方的相互关注、积极的心理状态以及持续的沟通意愿(Tickle-Degnen和Rosenthal,1990)。通过让20名参与者进行和谐关系情境实验并收集调查问卷,Nomura和Kanda(2016)开发了包含两个维度、共18个测项的“机器人和谐—期望”量表。其中,“作为对话伙伴的期望”这一维度由“当我和机器人说话时,如果被它忽视我会感到很难过”等评估机器人对话伙伴价值的11个测项测量;“对在一起的期望”这一维度则由“我接受这个机器人来参加我的家庭晚宴”等评估机器人关系价值的7个测项测量。

(二)人机陪伴(companionship)

随着智能语音助手、智能宠物等智能社交机器人的出现,其拟人化、个性化的交互风格以及提醒、健康监测、娱乐等多样化的功能使消费者与之在情感上越来越亲密,逐渐形成了一种类似人与人、人与宠物之间的情感陪伴关系。所谓陪伴是指人们感受到对方的近距离存在并产生一种亲密感和互相关心的关系,是出于满足或享受的内在动机而追求的一种社会参与(Rook,1987)。比如,Lee等(2017)发现韩国日益增长的独居消费者与智能家居设备之间存在明显的人机陪伴关系,并通过“我和智能家居设备有一段美好时光”“感受到它的存在”“与之共度休闲时光”“很乐意与之对话”4个测项来测量。进一步,Ramadan等(2021)通过分析三种不同来源的质性数据发现,存在社交障碍、孤独感较强的消费者与智能语音助手Alexa之间的关系发展经历了功能性福利提供者、朋友、伴侣、可依赖者这四个阶段。其中,在伴侣关系阶段,Alexa在消费者生活中扮演着能够随时对话的社交角色,使消费者产生信任感、依赖感、安全感和舒适感,很大程度上缓解了他们的孤独感和社会隔离感。消费者甚至对Alexa进入他们的生活充满感激之情。此外,Andreallo(2022)的研究也证实,缺乏人际陪伴的消费者确实能够从陪伴机器人身上感受到关注、可靠、支持、信任和善意,从而产生一种真实的陪伴感。

(三)人机准友谊(para-friendship)

基于准社会互动理论视角,Ki等(2020)认为消费者事实上将智能语音助手看作一种类人的社会互动对象。它们越具有人类的特征,人们就会越多地将人际社会规则和社会反应应用于人机互动过程。研究显示,除了上述情感陪伴关系,一些消费者与智能家居助手之间还形成了一种准友谊关系,即消费者希望向某个实体进行自我披露并对该实体产生能够提供社会支持的伙伴感(Liebers和Schramm,2017;Ki等,2020),包括自我披露和社会支持两个维度。其中,自我披露是指个体可以向他人倾诉自己真实的感受和想法,而社会支持是指个体感到自己被关心并在需要时有朋友可以求助(Tukachinsky,2010)。

(四)人机情感依恋(emotional attachment)

情感依恋最初是由于母亲对婴儿的回应、关怀和照顾而产生的一种平和、安全的情感纽带关系,包括安全基础、安全天堂、接近维持和分离焦虑四方面特征。而近期研究显示,在长期的陪伴、互动和照顾过程中,许多儿童对智能机器狗AIBO也形成了类似的情感依恋,完全满足以上四个依恋标准(Rabb等,2022)。而且,Björling等(2020)通过对来自四所学校的45名高中生进行机器人互动田野实验,发现青少年对智能社交机器人也会产生情感依恋,纷纷表示“它太可爱了”“你不想对它说不”以及“你想和它交谈”等。此外,Xie和Pentina(2022)对虚拟聊天机器人Replika的14位使用者进行了深度访谈与质性编码,被访者证实自己在与Replika交互的过程中形成了情感依恋,包括安全基础、安全天堂、接近维持和分离焦虑四个特征。他们发现,那些处于焦虑与孤独状态、缺乏人际陪伴的个体更容易从拟人化的智能社交机器人那里得到安慰、情感支持和心理安全感。最新的,Singh(2022)、Zhang和Rau(2023)以及Pentina等(2023)都通过实证研究多次证实消费者与智能社交机器人之间存在情感依恋关系。

(五)人机至爱(love)

随着自然语言处理和机器学习等先进技术的不断成熟,智能语音助手的实时沟通能力越来越强。它们不仅能够理解、回应主人的需求,并像真人助理一样高效地为主人解答问题,而且还能与主人共情,并学习其个人偏好。当这种智能体验越来越强时,消费者自然而然地会与之形成强烈的情感联结。最新研究发现,消费者与智能语音助手之间甚至会产生至爱的情感关系。基于Sternberg(1986)的爱情三角理论,Hernandez-Ortega和Ferreira(2021)以及Song等(2022)的研究都证实了人机至爱关系的存在,发现它与人际至爱关系一样,都包含亲密、激情和承诺三个维度。

综上所述,基于各自的研究情境和理论视角,学者们借用不同的社会心理学概念来研究人机情感关系的性质和程度,主要形成了以上五种彼此联系但具有不同侧重点的人机情感关系类型。可以看出,随着智能社交机器人拟人化程度和智能化程度的提高以及人机互动的加强,人机情感关系的内涵也在不断丰富。用于提供一般服务的智能社交机器人可以与消费者建立起基本、友好的和谐关系,而拟人化程度更高、更个性化、情感交互能力更强的智能社交机器人(如智能语音助手、智能宠物、智能陪伴机器人、虚拟聊天机器人等)则可能根据其不同的功能定位与消费者建立起陪伴、准友谊、情感依恋甚至至爱等深层次的情感关系。虽然这些概念之间彼此存在一定程度的交叠,并非完全独立,但它们都为学者们理解人机情感关系并进一步探究其形成机制和影响后果奠定了丰富、有趣且有价值的概念基础,极大地拓宽了人机关系研究视野。此外,这些研究也表明,智能社交机器人并不是生硬、冰冷的机器,而会被人们看作“有生命”“有情感”的社会参与者。它们不仅能为消费者提供功能价值,也会与消费者在长期交互的过程中形成不同类型的情感关系。

三、人机情感关系的形成机制不同类型的人机情感关系究竟是如何形成的?其形成机制又有何差异呢?现有研究发现,在不同类型人机情感关系形成过程中,机器人的外观和交互设计因素发挥着主要影响,消费者个体因素一般作为调节变量发挥作用。

(一)智能社交机器人的设计因素

1.人机和谐导向的设计因素

现有研究发现,人机和谐关系的形成主要依赖于智能社交机器人的语言、表情和肢体行为等。比如,Seo等(2018)组织36名被试与机器人共同完成布料分拣任务,并通过问卷调查以及对此过程中被试赞扬/批评机器人等行为进行视频编码,总结归纳了建立和阻碍人机和谐关系的语言和非语言行为,比如面部表情和凝视是最常见的建立和谐关系的非语言行为,使用攻击讽刺语言或批评机器人会阻碍人机和谐关系的建立。Wilson等(2017)探索了机器人的多种行为及其组合对人机和谐关系所产生的影响,发现手势和口语“OK”对人机和谐关系具有积极影响,而这两者的结合总是比单独的手势更受欢迎。另外,依靠麦克风和摄像机获得用户的语言和运动特征并通过姿势变化提供实时的积极反馈也有利于人机和谐关系的建立(Gratch等,2007)。

2.人机陪伴和准友谊导向的设计因素

目前,关于人机陪伴导向设计因素的研究很少。Lee等(2017)通过实验研究发现,内在社会联系和外部社会联系可以积极影响消费者在智能家居环境中的感知社会支持,进而积极影响感知陪伴。其中,内在社会联系是指用户和自己家中的智能家居设备共享信息而产生的亲密感与归属感,而外部社会联系是指用户和父母或朋友等其他人家中的智能家居设备共享信息而产生的亲密感与归属感。而在准友谊导向的设计因素方面,Leite等(2013)通过单因素(共情vs. 控制)的机器人观看下棋实验发现,与中性行为机器人相比,人们对具有面部表情和口头表达等共情行为的机器人表现出更高的感知友谊评价。此外,Jeong等(2018)通过持续四周的现场实验与访谈,发现社交机器人能够向用户提供功能和情感方面的社会支持,这有利于形成人机准友谊关系。最新地,通过对335份有效问卷的数据分析,Ki等(2020)探究了用户与智能语音助手建立准友谊的过程机制,发现智能语音助手所提供的亲密感、理解感、愉快感和参与感四个因素会积极影响人机准友谊的两个维度(自我披露和社会支持),进而提升消费者的黏性意愿(stickiness intention)。可见,人机陪伴和准友谊的形成需要机器人具有较强的情感互动能力,包括为消费者提供社会联系、社会支持、共情以及多种积极感受等。

3.人机情感依恋导向的设计因素

Pantano和Scarpi(2022)的研究最早发现,具备较强逻辑—数学能力、视觉空间能力、社交能力与语言沟通能力的智能社交机器人能够激发消费者的积极情绪,进而增强满意度、持续使用意愿和人机情感依恋。与此同时,研究发现智能语音助手的拟人化程度和用户对彼此关系的信任程度能够积极影响人机情感依恋,进而提升人机情感联结、满意度和购买意愿(Singh,2022);人类相似性能够显著提升人机情感依恋,进而促进消费者的感知互动意愿和购买意愿(Kim等,2022)。随后,Zhang和Rau(2023)通过实验研究发现,拟人化水平(像人vs.像机器)与社会角色(仆人vs.顾问)的交互效应对人机情感依恋存在显著影响。具体而言,在拟人化程度高(虚拟形象和沟通方式都更像真人)并扮演顾问角色时,消费者所产生的人机情感依恋更强,社会存在感在这一过程中发挥显著中介作用。类似地,沈鹏熠等(2023)通过单因素(聊天机器人角色:助手型vs.朋友型)组间实验探索了人工智能聊天机器人的不同角色对人机情感依恋的影响机制。他们发现,相比助手型聊天机器人,朋友型聊天机器人能够显著提升用户的控制感和身份认同感,进而提高用户的情感依恋程度。此外,Pentina等(2023)所构建的“人类—人工智能依恋关系发展模型”显示,对于那些与聊天机器人进行更频繁互动的用户来说,人工智能拟人化与人工智能真实性能够引发他们更强烈的社会互动意愿,进而提升人机情感依恋。可见,人机情感依恋的形成主要依赖于智能社交机器人的拟人化、人类相似性以及扮演合适的角色等因素。

4.人机至爱导向的设计因素

Hernandez-Ortega和Ferreira(2021)针对智能语音助手的研究发现,人机至爱在智能体验影响服务忠诚度的关系中发挥显著的中介作用。具体而言,智能体验能够积极影响激情,激情积极影响亲密和承诺,进而显著提升消费者的持续使用意愿、口碑意愿和电子口碑意愿。类似地,Song等(2022)通过大样本问卷调查并基于至爱理论提出了智能语音助手情境下的“亲密—激情—使用意愿”关系模型,发现智能语音助手的表现效能(performance efficacy)会积极影响用户激情,情感能力(emotional capability)会积极影响用户亲密和激情,进而提升用户对智能语音助手的承诺和使用意愿。总体来看,智能社交机器人所带来的高度的智能体验能够促进人机至爱关系的形成。

(二)消费者个体因素

在实际生活中,并非所有的消费者都会与智能社交机器人建立情感关系。事实上,人们对待智能社交机器人的态度存在明显的个体差异(Marieke等,2011)。已有研究显示,影响人机情感关系形成的消费者个体因素包括年龄、性别以及内在心理倾向等。

1.年龄与性别

首先,年龄显著影响人机情感关系的形成与发展过程。研究发现,超过一半的15岁儿童将机器人Robovie看作是精神、社交和部分道德意义上的实体,但其程度低于9岁和12岁的儿童;与年龄较大的儿童相比,年龄较小的儿童在与机器人互动的过程中体验到更多的乐趣,更容易产生拟人化倾向并与之形成情感关系(van Straten等,2020)。Weiss等(2009)通过对129名儿童和18名成人进行的案例对比发现,儿童迅速对机器狗AIBO产生了情感依恋,而成年人却需要比儿童更长的第一印象接触来建立对AIBO的情感依恋。其次,性别也会影响人机情感关系的形成与发展。有研究发现,与男孩相比,女孩普遍更看重智能社交机器人的社交属性,更容易建立人机情感关系(Westlund等,2018)。

2.内在心理倾向

研究显示,个体的许多内在心理倾向会对他们与智能社交机器人的情感关系产生重要影响。比如,Kim等(2013)通过对60名大学生被试进行单因素组间(机器人医生vs.人类医生)实验,发现具有更强归属需求(need to belong)(Baumeister和Leary,2017)的个体更有可能接受机器人并与其建立情感关系。在人机情感依恋方面,研究发现具有较强社交动机的用户更倾向于对智能语音助手产生人机情感依恋(Pentina等,2023);具有更强沉浸倾向(immersive tendency)(Witmer和Singer,1998)的消费者会在脑海中触发更强的“计算机作为社会行动者”图式,从而导致他们对智能社交机器人产生更强的社会临场感和信任感,进而提升人机情感依恋;当消费者感知自身与聊天机器人的心理距离更远时,其控制感和身份认同感会更高,进而引发更高程度的人机情感依恋(沈鹏熠等,2023);个体的自我披露意愿越高,智能社交机器人拟人化对人机情感依恋的影响也会越强烈(Singh,2022)。此外,Song等(2022)的研究发现,消费者的高信任倾向(trust disposition)在智能语音助手的表现效能和情感能力影响人机至爱的过程中发挥显著的调节作用。具体而言,对于那些生活中对他人具有高信任倾向的用户来说,智能语音助手的表现效能对用户激情的影响会更强,情感能力对用户亲密感和激情的影响也会更强。

综上所述,学者们已通过研究初步识别出不同类型人机情感关系的形成机制,包括智能社交机器人的外观和交互设计因素以及消费者个体因素,有的还揭示了具体的心理中介机制(见表1)。这些发现为我们打开了不同类型人机情感关系形成过程的“黑箱”,一方面深化和丰富了人机情感关系领域的研究,另一方面也能为营销者根据智能社交机器人的功能定位和目标人群来培育相应的人机情感关系提供有价值的、可行的策略建议。通过对比可以看出,实现人机和谐关系主要有赖于机器人的语言、表情和肢体行为等设计,实现人机陪伴和准友谊则需要更多的情感互动设计,实现人机情感依恋需要机器人更高程度的拟人化以及扮演合适的社会角色,而实现人机至爱则需要机器人能带来较高的智能体验,具有较高的表现效能和情感能力。

| 关系类型及内涵 | 代表文献 | 自变量 | 调节变量 | 中介变量 | 因变量 |

| 人机和谐 (相互感兴趣、愿意沟通和融洽相处的友好关系) |

Wilson等,2017 | 手势和口头致谢及其组合 | — | — | 人机和谐 |

| Gratch等,2007 | 积极反馈 | — | — | 人机和谐 | |

| Seo等,2018 | 语言和非语言 行为 |

— | — | 人机和谐、喜爱、希望机器人成为同事 | |

| 人机陪伴 (近距离存在、亲密感和互相关心的关系) |

Lee等,2017 | 内在社会联系、 外部社会联系 |

— | 感知社会支持 | 人机陪伴 |

| 人机准友谊 (自我披露和 社会支持) |

Leite等,2013 | 共情行为 | — | — | 人机准友谊 |

| Ki等,2020 | 亲密感、理解感、 愉快感、参与感 |

— | 人机准友谊 | 黏性意愿 | |

| 人机情感依恋 (平和、安全的情感纽带关系,包括安全基础、安全天堂、接近维持和分离焦虑) |

Kim等,2013 | 照顾者角色 | 归属需求 | 感知利益、 社会临场感 |

情感依恋 |

| Pantano和 Scarpi,2022 |

人工智能类型 | — | 积极情绪 | 满意度、持续意愿、 情感依恋 |

|

| Pentina等,2023 | 拟人化、真实性 | 社交动机 | 社会互动意愿 | 情感依恋 | |

| Zhang和 Rau,2023 |

拟人化水平、 社会角色 |

— | 社会临场感 | 情感依恋、满意度、 信息披露倾向 |

|

| 沈鹏熠等, 2023 |

聊天机器人角色 | 心理距离 | 控制感、 身份认同感 |

情感依恋 | |

| Singh,2022 | 拟人化、对关系的信任 | 自我披露 | 情感依恋、自我—人工智能联结 | 满意度、回购意愿 | |

| Kim等,2022 | 人类相似性 | — | 情感依恋、 感知互动性 |

购买意愿 | |

| 人机至爱 (强烈的情感联结,包括亲密、激情和承诺) |

Hernandez- Ortega和 Ferreira,2021 |

智能体验 | — | 人机至爱 | 持续使用意愿、口碑意愿、电子口碑意愿 |

| Song等,2022 | 表现效能、 情感能力 |

信任倾向 | 人机至爱 | 使用意愿 |

营销领域的研究表明,不同类型的人机情感关系均能明显地提升消费者对智能社交机器人的态度和行为意愿。此外,一系列来自机器人工程和伦理学领域的相关研究还发现,人机情感关系的建立有助于为消费者提供能力支持,促进消费者心理健康,但同时也会产生诸如情感欺骗、不道德对待、过度依赖、替代恐惧等负面影响和伦理问题。

(一)积极影响

1.改善消费者态度和行为意愿

研究显示,人机和谐关系能够改善消费者对智能社交机器人的态度、接受意愿和信任感(Seo等,2018)。人机陪伴关系能够使用户与智能家居系统建立起一种可持续的关系,对用户的长期使用意愿具有重要影响(Lee等,2017)。人机准友谊也能有效促进用户的持续使用行为(Jeong等,2018),提升消费者的黏性意愿(Ki等,2020)。而Kim等(2022)通过问卷调查研究发现,人机情感依恋对社交机器人的感知互动性和消费者购买意愿具有显著的积极影响。类似地,Singh(2022)通过三项实验研究证实,人机情感依恋能够增强消费者与人工智能之间的联结,进而提升顾客的满意度和回购意愿。Hernandez-Ortega和Ferreira(2021)以及Song等(2022)的研究则发现,消费者对智能语音助手的人机至爱(包括激情、亲密和承诺)能够显著提升消费者的持续使用意愿、口碑意愿和电子口碑意愿。综合来看,现有研究发现不同类型人机情感关系所带来的积极结果比较接近,都聚焦在消费者的积极态度、购买意愿和长期使用意愿等方面。

2.为消费者提供能力支持

研究显示,在作为辅导老师或学习伙伴提供课程学习支持的情境下,与消费者建立起和谐关系的智能社交机器人能够带来更高的情感学习效果(接受能力、反应能力、注意力、反思能力)和认知学习效果(知识、理解、分析和评价)(Belpaeme等,2018)。此外,智能陪伴机器人可以改善患者和治疗师之间的沟通,通过鼓励患者的模仿或同步行为来帮助孤独症患者提高社交技能,增强训练意愿,支持其上肢和下肢的运动功能和运动康复(Lorenz等,2016)。即使在认知和感觉功能严重受损的情况下,智能陪伴宠物也可以作为社会互动的媒介显著提高患者的参与、互动、交流意愿,为他们的生活带来更强的意义感(Marti等,2005)。因此,具有情感交互能力、能与人建立良好情感关系的智能社交机器人在为患有疾病的特殊弱势群体提供认知和功能支持方面发挥着积极作用,在应对人口老龄化危机、不断攀升的医疗成本以及医护人员短缺等方面具有重要现实意义(Feil-Seifer等,2020)。

3.促进消费者心理健康

研究显示,与智能社交机器人建立积极的情感关系能够给用户带来更高的亲密感和享受度(van Straten等,2020)、缓解抑郁情绪(Lorenz等,2016)、提供情感安慰并改善情绪健康(Prescott和Robillard,2021)。比如,Benyon和Mival(2010)的研究发现,消费者与智能社交机器人的陪伴关系中包含信任和熟悉感,能够唤起消费者的积极情绪、情感投资、归属感和社会角色,使消费者产生安全感、满足感和幸福感。而且,Khosla和Chu(2013)在澳大利亚三家养老院进行的问卷调查发现,老人们会与具备类人特征、互惠设计与沟通交流特征的情感陪伴机器人保持友善关系,从而提高他们的感知护理质量和感知护理个性化水平,最终改善他们自身的情绪健康。此外,在安全依恋关系中,依恋对象的存在和干预具有缓解幼儿消极情绪、诱导幼儿积极情感的作用(Prescott和Robillard,2021)。Jeong等(2018)将社交机器人用于解决单身成年人的社会孤立问题。通过现场实验与四次访谈,他们发现社交机器人可以通过共享日常活动噪声来制造“有人在身边”的假象并为用户带来虚拟的同居体验,从而引发更频繁的现实世界社交互动,减轻孤独感。最新地,Law等(2022)通过创设四种不同的人机交互场景,发现人机情感关系能够提高消费者对智能社交机器人的感知有效性和接受度,从而弥补人际关系方面的缺失,提高幸福感。

(二)消极影响

1.情感欺骗

伦理学和技术哲学领域的学者指出,消费者有可能被智能社交机器人的“社交行为”所欺骗(Law等,2022)。智能社交机器人不仅具有人形的外表,而且还可以通过语言、面部表情、肢体行为等来模仿人类情感,因而人们可能相信人工智能表达了“真实”的情感,依赖它们进行情感互动和情感支持,从而陷入自我欺骗的“虚假关系”和“自我表演”之中(Sharkey和Sharkey,2021;Sætra,2021)。虽然由集成电路组成的智能社交机器人本身不带有任何主观意志,但是其拟人化外观却通过假扮人类行为和情感来“欺骗”精神受损的儿童和老人等弱势群体,这降低了人类尊严,从长期来看可能会引起情感或心理上的伤害。

2.不道德对待

儿童可能会与智能社交机器人建立主仆关系从而导致对智能社交机器人的不道德对待,这可能会蔓延至儿童对待同龄人的态度(Kahn等,2013)。由于智能社交机器人总是无条件地接受和执行儿童所发出的语音命令,而儿童从不需要适应智能社交机器人的需求,这就导致了一种不平等的主仆关系氛围,进而可能引发一些儿童对智能社交机器人在言语、行为方面的不道德对待(如不礼貌用语、辱骂、破坏、殴打等),这将会给儿童的身心健康以及儿童之间的健康人际关系带来负面影响(Bartneck和Keijsers,2020;Coeckelbergh,2021)。

3.过度依赖

一些研究也揭露了人机情感依恋可能导致的潜在黑暗面(Xie和Pentina,2022)。智能社交机器人可以帮助我们获得社交技能,充当与他人建立关系的催化剂,具有轻松、方便、无挑战的优点。然而,过度依赖智能社交机器人也会误导人们的时间和情感投资方向(Bryson,2018),可能使用户没有能力或者不再愿意关心他人并与他人成为朋友。这将降低用户的自主性,破坏用户参与真实人际关系的意愿,减少用户与人类接触的可能性,进而破坏安全依恋能力,威胁人们的长期幸福感(Turkle,2017)。

4.替代恐惧

有学者警告,人机情感关系也会进一步加剧人们对“机器人会取代人类”这一预言的恐惧感和威胁感。有研究显示,机器人被很多人视为对人类工作、资源和安全的威胁(Złotowski等,2017),而机器人和人类之间过于相似会引起人们关于人类和机械个体之间是否存在区别的担忧,进而威胁人类自身的身份感(Ferrari等,2016)。随着智能社交机器人的快速发展,其高度类人的外表和无法比拟的性能优势,未来有可能引发刻板印象、偏见、隐私担忧等一系列社会问题(Andreallo,2022)。毕竟,人们在情感上很难接受自己照顾和陪伴父母的重要角色有朝一日被智能机器人替代。

综上所述,本部分的诸多跨领域研究为我们揭示了人机情感关系的“双刃剑”效应。它一方面能够明显改善消费者对智能社交机器人的态度和行为意愿,为消费者提供能力支持,促进消费者心理健康,但另一方面也会产生诸如情感欺骗、不道德对待、过度依赖、替代恐惧等负面影响和伦理问题。这些研究将人机情感关系的讨论话题进一步延伸和拓展,是对本领域研究的重要补充和完善。学者们在肯定人机情感关系的同时,也向我们发出了警告,指出了可能随之而来的一系列负面后果和潜在伦理风险,发人深省,值得持续关注。

五、总结与讨论通过系统地回顾与梳理消费者与智能社交机器人之间的人机情感关系相关文献,本文首次从关系类型、形成机制和影响后果这三个方面总结和提炼出人机情感关系研究的现有理论框架(如图1所示),反映出了该领域的研究脉络。同时,已有成果为学者们的后续研究奠定了坚实的基础,也提供了丰富的未来研究方向,而且能够为人工智能企业开展情感导向的智能社交机器人设计、选择合适的目标群体以及政府制定符合伦理道德的行业规范提供理论指导与实践启示。

|

| 图 1 人机情感关系研究的理论框架 |

(一)未来研究展望

1.探索人机情感关系的本质特征

虽然学者们已基于不同研究情境和理论视角提出了五种主要的人机情感关系类型,但由于该领域研究刚刚起步而且文献数量偏少,其测量方式的合理性和可靠性仍需要更多检验。现有研究大多直接照搬其他领域的概念和测量方式并将其应用于智能社交机器人场景(如人机情感依恋、人机至爱)。那么,人机情感依恋和其他依恋关系(人—人依恋、人—物依恋、人—宠物依恋)的本质差异又是什么?它都包含哪些具体维度和类型?是否会呈现出一个类似光谱的程度差异谱(强依恋和弱依恋)?这些问题还需要进一步探究。另外,除了现有概念,人机情感关系是否还存在其他类型呢?而且,人机情感关系是一个动态变化的过程,因此未来可以进一步探究消费者与智能社交机器人的关系旅程、阶段特征以及关系断裂的过程和原因(Novak和Hoffman,2019)。最后,鉴于现有研究的样本多来自国外,中国文化背景下的人机情感关系内涵又会有怎样的不同?这还有待更多本土文化情境下的人机情感关系研究去揭示。

2.深入揭示人机情感关系的形成机制

现有研究仅初步识别出不同类型人机情感关系的形成机制,未来研究还可以结合更多的理论视角在这方面继续深入探讨。比如,在外观设计方面,感知可爱往往能够诱发消费者的温暖感、愉悦感和互动意愿(Guo等,2023),拉近机器人与消费者的心理距离,那么智能社交机器人的感知可爱是否能促进人机情感关系呢?另外,已有研究证实,他人的情感型抚摸(affective touch)能够为个体提供情感支持,加强彼此之间的情感联系,在促进人际关系发展中扮演着重要角色(Andreasson等,2018),那么智能社交机器人的表面材质类型是否会影响消费者的情感抚摸意愿进而影响人机情感关系呢?具体而言,相比坚硬、光滑的材质,柔软、毛绒的机器人表面材质是否更容易诱发消费者的情感抚摸意愿进而提升人机情感关系呢?

除了以上外观设计因素,智能社交机器人如何通过情感互动来提升人机情感关系是未来值得研究的重点方向。比如,已有研究发现人工智能共情能够提升消费者的情感和社交体验(Liu-Thompkins等,2022),那么,智能社交机器人的共情式回应能力是否能够显著提升人机情感关系?鉴于自我披露(self-disclosure)和共同经历(shared experience)是人际情感关系发展过程中的重要影响因素(van Straten等,2020;Gaggioli等,2021),智能社交机器人的主动自我披露行为是否能拉近消费者的感知心理距离并提升人机情感关系?智能社交机器人主动邀请用户共同完成一些有趣的活动是否能通过“积极共同经历”促进人机情感关系?另外,鼓励用户参与智能社交机器人的设计以及个性化命名等定制化策略是否也能提升用户的心理所有权进而促进人机情感关系呢(Delgosha和Hajiheydari,2021)?

此外,未来研究也需要考虑更多的情境因素和消费者个体特征来揭示不同情况下人机情感关系的形成机制。比如,智能社交机器人的功能定位(社交陪伴还是情感抚慰)、使用场景类型(家庭还是公共场所)以及人机个性的匹配性(一致或互补)将如何影响人机情感关系(Mou等,2020)?消费者自身的依恋风格、孤独感知以及对待智能社交机器人的态度和信念又将如何影响人机情感关系的形成(Gillath等,2021;Youn和Jin,2021)?

3.探究并验证人机情感关系的影响后果

随着智能社交机器人变得越来越复杂、精密和“通人性”,它们必将深远地影响人类生活,它们与人类所形成的新型情感关系也会不断升温。因此,我们需要持续考察人机情感关系的影响后果,努力发挥其积极效应,警惕并抑制其消极效应。我们应该成为智能社交机器人的主人而非奴仆,以避免陷入“群体性孤独”(雪莉•特克尔,2014)。值得进一步探究的问题包括:不同类型人机情感关系究竟在影响后果方面有何差异?是否会发挥不同的积极作用?除了积极态度和持续使用意愿,人机情感关系还能为机器人品牌带来哪些积极营销效果呢?比如,鉴于获取用户数据对于优化算法的重要性,人机情感关系是否会提升消费者的自我披露意愿并降低隐私保护关切?它是否能提高消费者的溢价支付意愿并使消费者更愿意听取智能社交机器人的购买建议?此外,研究显示消费者对智能音箱Alexa的喜爱和对亚马逊品牌的喜爱之间存在显著正相关关系(Ramadan等,2021)。那么,人机情感关系又如何影响消费者与推出智能社交机器人的母公司品牌之间的关系?

同时,当前学者们对人机情感关系消极影响的探讨还较少,而且主要以伦理学领域的定性探讨为主。因此,智能社交机器人所带来的情感欺骗、过度依赖等问题是否真实存在还有待进一步的实证检验。研究显示,有的消费者认为智能社交机器人具有生命性和精神意识,有其自身感情,属于一种社会存在(如可以成为人类的朋友、为人们提供安慰、分享秘密等),具有一定的道德地位(如值得公平对待、不应被伤害),但没有自己的自由和权利(Kahn等,2012)。然而,随着人机情感关系的深入,智能社交机器人未来是否会被赋予更高的道德地位呢?人机情感关系又会引发哪些新的社会问题也有待持续观察和研究。

(二)实践启示

1.树立情感导向的智能社交机器人设计理念

当前,市场上已推出的智能社交机器人在与消费者建立情感关系方面还有许多不足。而本文对国外相关研究的梳理显示,消费者与智能社交机器人完全可以构建丰富的、不同类型的人机情感关系,而且这种情感关系能够促进消费者对智能社交机器人的接受度、满意度、持续使用意愿和口碑,也能显著提升他们的情绪健康和幸福感。因此,相关企业应该更新设计理念,在注重社交机器人的功能价值之外,更要从整体用户体验的角度重视赋予社交机器人情感价值,积极践行情感导向的智能社交机器人设计理念,根据其功能定位和目标人群努力培养和维护消费者与智能社交机器人之间特定类型的情感关系,从而增强我国智能社交机器人产品的竞争力。

2.情感导向的智能社交机器人营销策略

相关企业可以通过改进产品设计、聚焦目标群体、优化广告传播三方面的营销策略来提升智能社交机器人的情感互动能力,增强人机情感关系,进而提高营销绩效。首先,在产品设计方面,企业可以通过拟人化设计以及具有“萌态”属性的可爱外形设计提高智能社交机器人的可亲近感和吸引力;通过幽默的语言、礼貌的态度、丰富的面部表情等共情式表达方式,增强消费者的社会临场感;通过优化智能社交机器人的社会角色定位使消费者感知到充分的社会支持;通过让消费者自主命名、自主选择相关设置等方式提高消费者的自主感和控制感等。其次,在目标群体方面,营销人员可以进一步聚焦于儿童、单身青年、空巢老人以及具有相关心理需求的群体,进一步开展智能社交机器人的定制化开发,以提高用户满意度。最后,在广告传播方面,相关企业可以强调机器人的亲社会定位和温馨、静谧、和谐的情感陪伴场景,以智能社交机器人对相关目标人群的关爱为主题,凸显机器人的情感价值,强调其对消费者情绪健康、生活质量和幸福感的重要积极作用,以提高广告传播效果。总之,相关企业应该重视研究消费者行为和心理,将心理学、美学、伦理学和工程学等多学科知识相结合,打造出能满足消费者心理需求的真正意义上的智能社交机器人。

3.努力构建有意义的、健康的、符合伦理的人机情感关系

一方面,鉴于人机情感关系可能带来负面效应和伦理问题,相关企业需要负责任地通过优化产品设计、完善产品使用说明、广告传播等方式来引导消费者适度、合理、正确地使用智能社交机器人。比如,强调智能社交机器人的辅助角色,纳入防沉迷设置,限制消费者的持续使用时长,并积极鼓励消费者与外界社会互动,在消费者自主完成任务时进行正向激励,避免消费者过度沉迷与依赖。另一方面,鉴于智能社交机器人产业的快速发展,政府也需要及时研究和出台相应的伦理规范和行业发展指导意见,以约束企业营销行为,在充分发挥智能社交机器人积极作用的同时,限制、管控其负面作用,使智能社交机器人更好地为人类服务,提高人类福祉。

| [1] | 杜建刚, 赵欢, 苏九如, 等. 服务智能化下的顾客行为: 研究述评与展望[J]. 外国经济与管理, 2022, 44(3): 19–35. |

| [2] | 林子筠, 吴琼琳, 才凤艳. 营销领域人工智能研究综述[J]. 外国经济与管理, 2021, 43(3): 89–106. |

| [3] | 沈鹏熠, 李金雄, 万德敏. “以情动人”还是“以理服人”? 人工智能聊天机器人角色对顾客情感依恋的影响研究[J/OL]. 南开管理评论, http://kns.cnki.net/kcms/detail/ 12.1288.F.20230613.1755.004.html, 2023-06-14. |

| [4] | 王美莹, 杨飒, 张雪瑜, 等. 积极看待“孤独经济” 引导青年即使“空巢”也勿“空心”[N]. 光明日报, 2020-11-11(07). |

| [5] | 雪莉·特克尔著; 周逵, 刘菁荆译. 群体性孤独[M]. 杭州: 浙江人民出版社, 2014. |

| [6] | 闫志民, 李丹, 赵宇晗, 等. 日益孤独的中国老年人: 一项横断历史研究[J]. 心理科学进展, 2014, 22(7): 1084–1091. |

| [7] | 朱国玮, 高文丽, 刘佳惠, 等. 人工智能营销: 研究述评与展望[J]. 外国经济与管理, 2021, 43(7): 86–96. |

| [8] | Andreallo F. Human–robot companionship: Cultural ideas, limitations, and aspirations. An analysis of sex robot marketing videos[J]. International Journal of Social Robotics, 2022, 14(10): 2109–2122. |

| [9] | Andreasson R, Alenljung B, Billing E, et al. Affective touch in human–robot interaction: Conveying emotion to the Nao robot[J]. International Journal of Social Robotics, 2018, 10(4): 473–491. |

| [10] | Bartneck C, Keijsers M. The morality of abusing a robot[J]. Journal of Behavioral Robotics, 2020, 11(1): 271–283. |

| [11] | Belpaeme T, Kennedy J, Ramachandran A, et al. Social robots for education: A review[J]. Science Robotics, 2018, 3(21): 5954. |

| [12] | Björling E A, Rose E, Davidson A, et al. Can we keep him forever? Teens’ engagement and desire for emotional connection with a social robot[J]. International Journal of Social Robotics, 2020, 12(1): 65–77. |

| [13] | Bryson J J. Patiency is not a virtue: The design of intelligent systems and systems of ethics[J]. Ethics and Information Technology, 2018, 20(1): 15–26. |

| [14] | Coeckelbergh M. How to use virtue ethics for thinking about the moral standing of social robots: A relational interpretation in terms of practices, habits, and performance[J]. International Journal of Social Robotics, 2021, 13(1): 31–40. |

| [15] | Delgosha M S, Hajiheydari N. How human users engage with consumer robots? A dual model of psychological ownership and trust to explain post-adoption behaviours[J]. Computers in Human Behavior, 2021, 117: 106660. |

| [16] | Gaggioli A, Chirico A, Di Lernia D, et al. Machines like us and people like you: Toward human–robot shared experience[J]. Cyberpsychology, Behavior, and Social Networking, 2021, 24(5): 357–361. |

| [17] | Gillath O, Ai T, Branicky M S, et al. Attachment and trust in artificial intelligence[J]. Computers in Human Behavior, 2021, 115: 106607. |

| [18] | Guo L L, Liang J P, Huang Y S, et al. The impact of the cuteness of service robots on consumers’ interaction willingness[J/OL]. Current Psychology, https://doi.org/10.1007/s12144-023-05365-8, 2023-10-31. |

| [19] | Hernandez-Ortega B, Ferreira I. How smart experiences build service loyalty: The importance of consumer love for smart voice assistants[J]. Psychology & Marketing, 2021, 38(7): 1122–1139. |

| [20] | Jeong K, Sung J, Lee H, et al. Fribo: A social networking robot for increasing social connectedness through sharing daily home activities from living noise data[A]. Proceedings of the 2018 13th ACM/IEEE international conference on human-robot interaction[C]. Chicago: IEEE, 2018. |

| [21] | Khosla R, Chu M T. Embodying care in Matilda: An affective communication robot for emotional wellbeing of older people in Australian residential care facilities[J]. ACM Transactions on Management Information Systems, 2013, 4(4): 18. |

| [22] | Ki C W, Cho E, Lee J E. Can an intelligent personal assistant (IPA) be your friend? Para-friendship development mechanism between IPAs and their users[J]. Computers in Human Behavior, 2020, 111: 106412. |

| [23] | Kim J, Kang S, Bae J. Human likeness and attachment effect on the perceived interactivity of AI speakers[J]. Journal of Business Research, 2022, 144: 797–804. |

| [24] | Kim K J, Park E, Sundar S S. Caregiving role in human–robot interaction: A study of the mediating effects of perceived benefit and social presence[J]. Computers in Human Behavior, 2013, 29(4): 1799–1806. |

| [25] | Law T, Chita-Tegmark M, Rabb N, et al. Examining attachment to robots: Benefits, challenges, and alternatives[J]. ACM Transactions on Human-Robot Interaction, 2022, 11(4): 36. |

| [26] | Lee B, Kwon O, Lee I, et al. Companionship with smart home devices: The impact of social connectedness and interaction types on perceived social support and companionship in smart homes[J]. Computers in Human Behavior, 2017, 75: 922–934. |

| [27] | Leigh-Hunt N, Bagguley D, Bash K, et al. An overview of systematic reviews on the public health consequences of social isolation and loneliness[J]. Public Health, 2017, 152: 157–171. |

| [28] | Leite I, Pereira A, Mascarenhas S, et al. The influence of empathy in human–robot relations[J]. International Journal of Human-Computer Studies, 2013, 71(3): 250–260. |

| [29] | Liebers N, Schramm H. Friends in books: The influence of character attributes and the reading experience on parasocial relationships and romances[J]. Poetics, 2017, 65: 12–23. |

| [30] | Liu-Thompkins Y, Okazaki S, Li H R. Artificial empathy in marketing interactions: Bridging the human-AI gap in affective and social customer experience[J]. Journal of the Academy of Marketing Science, 2022, 50(6): 1198–1218. |

| [31] | Lorenz T, Weiss A, Hirche S. Synchrony and reciprocity: Key mechanisms for social companion robots in therapy and care[J]. International Journal of Social Robotics, 2016, 8(1): 125–143. |

| [32] | Mou Y, Shi C Q, Shen T Y, et al. A systematic review of the personality of robot: Mapping its conceptualization, operationalization, contextualization and effects[J]. International Journal of Human–Computer Interaction, 2020, 36(6): 591–605. |

| [33] | Nomura T, Kanda T. Rapport–expectation with a robot scale[J]. International Journal of Social Robotics, 2016, 8(1): 21–30. |

| [34] | Novak T P, Hoffman D L. Relationship journeys in the internet of things: A new framework for understanding interactions between consumers and smart objects[J]. Journal of the Academy of Marketing Science, 2019, 47(2): 216–237. |

| [35] | Pantano E, Scarpi D. I, robot, you, consumer: Measuring artificial intelligence types and their effect on consumers emotions in service[J]. Journal of Service Research, 2022, 25(4): 583–600. |

| [36] | Pentina I, Hancock T, Xie T L. Exploring relationship development with social chatbots: A mixed-method study of replika[J]. Computers in Human Behavior, 2023, 140: 107600. |

| [37] | Prescott T J, Robillard J M. Are friends electric? The benefits and risks of human-robot relationships[J]. iScience, 2021, 24(1): 101993. |

| [38] | Rabb N, Law T, Chita-Tegmark M, et al. An attachment framework for human-robot interaction[J]. International Journal of Social Robotics, 2022, 14(2): 539–559. |

| [39] | Ramadan Z, Farah M F, El Essrawi L. From Amazon. com to Amazon. love: How Alexa is redefining companionship and interdependence for people with special needs[J]. Psychology & Marketing, 2021, 38(4): 596–609. |

| [40] | Sætra H S. Social robot deception and the culture of trust[J]. Journal of Behavioral Robotics, 2021, 12(1): 276–286. |

| [41] | Seo S H, Griffin K, Young J E, et al. Investigating people’s rapport building and hindering behaviors when working with a collaborative robot[J]. International Journal of Social Robotics, 2018, 10(1): 147–161. |

| [42] | Sharkey A, Sharkey N. We need to talk about deception in social robotics![J]. Ethics and Information Technology, 2021, 23(3): 309–316. |

| [43] | Singh R. “Hey Alexa–order groceries for me” —The effect of consumer–VAI emotional attachment on satisfaction and repurchase intention[J]. European Journal of Marketing, 2022, 56(6): 1684–1720. |

| [44] | Song X, Xu B, Zhao Z Z. Can people experience romantic love for artificial intelligence? An empirical study of intelligent assistants[J]. Information & Management, 2022, 59(2): 103595. |

| [45] | Sternberg R J. A triangular theory of love[J]. Psychological Review, 1986, 93(2): 119–135. |

| [46] | van Straten C L, Peter J, Kühne R. Child–robot relationship formation: A narrative review of empirical research[J]. International Journal of Social Robotics, 2020, 12(2): 325–344. |

| [47] | Weiss A, Wurhofer D, Tscheligi M. “I love this dog”—Children’s emotional attachment to the robotic dog AIBO[J]. International Journal of Social Robotics, 2009, 1(3): 243–248. |

| [48] | Westlund J M K, Park H W, Williams R, et al. Measuring young children’s long-term relationships with social robots[A]. Proceedings of the 17th ACM conference on interaction design and children[C]. Trondheim: ACM, 2018. |

| [49] | Wilson J R, Lee N Y, Saechao A, et al. Hand gestures and verbal acknowledgments improve human-robot rapport[A]. Proceedings of the 9th international conference on social robotics[C]. Tsukuba: Springer, 2017. |

| [50] | Youn S, Jin S V. “In A. I. we trust?” The effects of parasocial interaction and technopian versus luddite ideological views on chatbot-based customer relationship management in the emerging “feeling economy”[J]. Computers in Human Behavior, 2021, 119: 106721. |

| [51] | Zhang A D, Rau P L P. Tools or peers? Impacts of anthropomorphism level and social role on emotional attachment and disclosure tendency towards intelligent agents[J]. Computers in Human Behavior, 2023, 138: 107415. |