2022第44卷第9期

随着大数据、云计算、人工智能等数字技术的发展,机器人和自动化生产技术在企业中的应用越来越广泛,特别是机器人越来越多地出现在人们的工作中(李磊等,2021;孙新波等,2021)。中国于2015年提出了《中国制造2025》国家规划并计划在2025年初步实现智能制造转型,作为“中国制造2025”确定的重点发展领域和智能制造的重要组成部分,工业机器人在制造业中的应用越来越普遍。2020年新冠肺炎疫情(COVID-19)更加速了机器人在各行各业的使用趋势,为了避免人员的密集接触,一些医院使用机器人运送食品和卫生用品等来降低感染风险,而包括必胜客在内的很多餐厅使用机器人进行无接触送餐。机器人的广泛应用引起了学术界和实践界的广泛关注,虽然在各行各业中机器人的使用如火如荼,但在实践中机器人并不能完全取代工人(Charalambous等,2015),人类和机器人协作(简称人机协作)将是未来重要的工作模式。作为一种技术变革,机器人不应该仅仅被视为一种工程挑战,对人的因素的忽视往往是阻碍组织从引入的技术变革中获取最大利益的主要障碍(Charalambous等,2015),人机协作对员工的影响受到学者们的广泛关注。

回顾已有研究,人机交互中的安全问题是学者们最初关注的重点,出于安全问题考虑,在最初使用机器人时人们通常避免其与人类有所接触(Hentout等,2019)。随着技术的进步,协作机器人的出现使得人机交互更加方便和安全,很多行业开始部署机器人来辅助人们进行工作,大量学者开始研究人与机器人的交互问题。机器人等学科的学者从机器人的设计出发研究其对人类的影响,包括机器人的外观、动作、交流方式等,对于了解人们对机器人的感知以及改良机器人具有重要意义。除了机器人方面的特点,学者们也开始考察人机交互的其他方面对人们的影响,包括空间位置、员工性格等。总的来说,现有人机协作研究取得了比较丰富的成果,但现阶段学者们的研究主要集中在各自学科的范围,尚缺乏系统的梳理总结和研究框架。人机协作的概念内涵是什么?哪些因素会对协作者产生影响,这些因素又如何影响员工?人机协作的不同实施情境会给员工和组织带来什么结果?回答上述问题可以为人机协作研究提供思路,也有助于推动企业人机协作实践的发展。

基于以上研究背景,本文将“人机交互/human-robot interaction/HRI”“人机协作/ human-robot collaboration/HRC”作为主题词,通过Web of Science、EBSCO、Scopus、中国知网等数据库收集文献,通过阅读文献标题、摘要和关键词进行筛选,排除与本文研究主题无关的文献,得到初始文献24篇。基于对这24篇文献的引用和对被引文献进行“滚雪球”式检索,本文涵盖了其他类型机器人相关文献,包括服务机器人、辅助机器人等,并排除了与本研究关联较小的文献,例如机器人系统开发、机器人对消费者的影响而非工作场所人机协作的文献。经过上述搜索和筛选,我们最终得到93篇文献。

梳理上述文献可知,人机协作的文献时间跨度较大,整体上滞后于机器人的应用实践,但又与机器人的发展密切相关。造成这种现象的原因主要有两个:一是早期机器人被视为人类的替代品,通常被安装在远离人类的工作空间执行任务(Hentout等,2019),而机器人相关研究集中在机器人设计与制造、计算机技术等领域。为了促进机器人的改进,一些学者开始探讨机器人对人类的影响并提出假设(如Mori,1970)。随着协作机器人的出现以及安全问题的改进,机器人与人类员工协同工作成为可能并不断普及,人机协作研究才相应蓬勃发展。二是理论基础和测量工具相对不完善,使得人机协作研究的开展存在困难,因此,早期的研究大多对人机协作的影响因素和影响结果进行探索性分析,直到近期才逐渐有深入的影响机制研究。从人机协作研究的发展脉络来看,早期人机协作对员工影响的研究大多基于技术视角,影响因素主要集中于机器人的外观、功能与性格特点,影响的方面聚焦于人们的威胁感和信任感。2010年以来,机器人以外的因素开始受到广泛关注,环境方面包括引入机器人造成的物理空间变化、组织层面的文化环境变化等,个体方面包括员工的性格特征、感知机器人的方式等,影响的方面拓展到员工的其他情绪和行为。

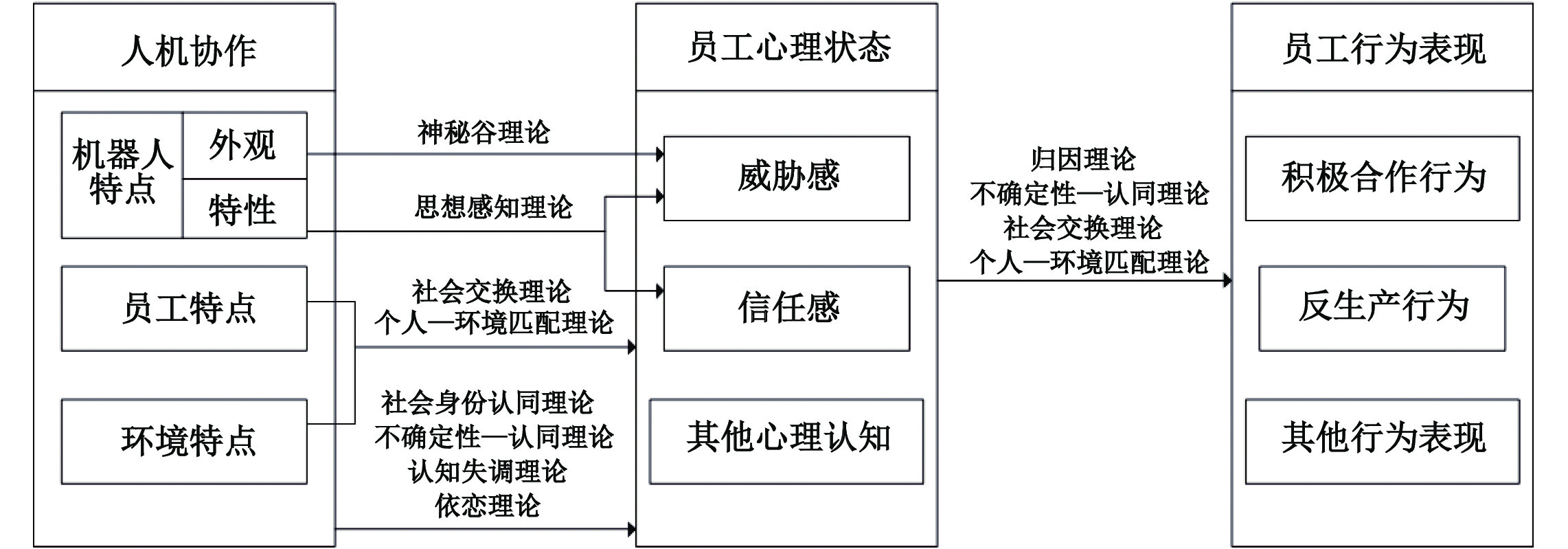

本文内容安排如下:首先对人机协作的概念内涵进行梳理分析,归纳出人机协作的三个核心要素;接下来,从人机协作的三个核心要素出发,总结人机协作引起的员工反应,并将相关影响归纳为心理状态和行为表现两个方面;然后,梳理现有研究涉及的理论,并对这些理论的解释内容和使用方式进行评析;最后,总结研究现状并提出实践启示与未来研究方向。本文的贡献在于:理论方面,厘清了人机协作概念并丰富了其内涵要素,以此为基础对现有文献进行了系统性梳理和归纳,总结了人机协作引起的员工反应和相关研究涉及的理论,提出了未来研究方向,以期推动人机协作研究的深入;实践方面,通过探讨人机协作的影响机制,能够帮助企业更好地了解员工的心理和行为反应,从而为企业人机协作的发展提供管理启示。

二、人机协作的概念(一)人机交互的发展与研究现状

机器人在过去几十年间得到了迅速普及和广泛应用,机器人相关领域的研究也取得了蓬勃发展(Hvilshøj等,2012)。作为一种替代或帮助人们高效、精确地执行各种重复、繁琐以及危险任务的机器(Isma和Brahim,2015),机器人在工业制造等领域受到了广泛欢迎。虽然机器人执行的工作和应用的领域不断拓展,但是人类员工仍发挥着重要作用。从技术层面看,现有机器人难以独立完成过于复杂的任务,人—机器人合作可以显著提高工作的可靠性(de Visser和Parasuraman,2011);从经济层面看,完全实现机器人自动化需要巨大的资金投入。因此,人与机器人共享工作任务和空间,并由人类员工协助机器人执行任务,是目前以及未来很长一段时间最灵活、最经济的解决方案(Hentout等,2019)。在此背景下,人与机器人之间的安全与交互成为重要研究领域。

Schmidtler等(2015)将人机交互(human-robot interaction,HRI)定义为“人类与机器人之间所有形式交互的总称”。Fang等(2014)认为人机交互是“传达人的意图并将任务描述转化为符合机器人能力和工作要求的一系列动作的过程”。“交互”也可以定义为“多个行为主体(人类或机器人)相互反应或交流的情景”(Chandrasekara和Conrad,2015)。Schmidtler等(2015)从工作空间、工作时间、任务目标以及接触情况四个维度将人机交互划分为三类:人机共存(human-robot coexistence,HRCx)、人机合作(human-robot cooperation,HRCp)以及人机协作(human-robot collaboration,HRC)。三种类型在四个维度上的比较如表1所示。

| 类型 | 工作空间 | 工作时间 | 任务目标 | 接触情况 |

| 人机共存 | 共享动态的

工作空间 |

存在参与者在共享空间中工作的时间 | 人与机器人目标可能不相同 | 不需要相互接触或协调 |

| 人机合作 | 共享工作空间 | 存在参与者在共享空间中工作的时间 | 人与机器人目标相同 | 通常避免人与机器人的碰撞 |

| 人机协作 | 共享工作空间 | 存在参与者在共享空间中工作的时间 | 人与机器人目标相同 | 人与机器人存在物理性接触或非物理性接触(如语音、手势、面部表情交流等)(Hentout等,2019) |

人机交互的发展吸引了计算机学、信息管理学以及心理学等不同领域的学者,学者们对人机交互的研究拓展到属性和要素分析。Yagoda和Gillan(2012)将人机交互分为团队组成、团队过程、情境、任务以及系统五个维度,认为人与机器人的关系是团队伙伴关系,并强调人机协作不仅与机器人、交互系统有关,与任务因素也有很大关系。Hancock等(2011)从心理学视角出发,将人机交互信任的影响因素划分为人类特点、机器人特点以及环境三类,其中环境因素包括团队协作、任务等。

出于安全性考虑,人机交互在很长一段时间里停留在人机共存和人机合作阶段,而协作机器人的出现实现了人与机器人之间的安全交互(Hentout等,2019)。协作机器人是一种为了与人类合作完成特定任务而专门设计并制造的机器人,其可接触、防碰撞的优势避免了交互场景的安全问题(Bitonneau等,2017)。自2008年起,协作机器人被大规模生产并运用于各个行业,例如Universal机器人公司推出的UR5、ABB公司推出的Yumi等。人机协作逐渐成为工作场所的重要趋势,学术界对人机协作产生了浓厚的研究兴趣(Hentout等,2019)。

(二)人机协作的内涵和要素

国际标准化组织(2011)将人机协作定义为一种“人与机器人共享一个工作空间的特殊操作”。Hentout等(2019)认为人机协作是“人与机器人通过物理或非物理接触的方式直接交互,以执行某些复杂的任务”。Ajoudani等(2018)强调“人—机器人—任务环境”系统,将人机协作定义为“人、机器人和环境相互接触并形成一个耦合的动态系统以完成一项任务”。随着人机交互发展到新的阶段,人与机器人在工作中共享时间和空间,存在接触互动以及共同的目标,已经成为人机协作的必要要素。结合相关文献的观点,本文认为人机协作是指:人与机器人共享时间和空间,相互接触并形成一个动态系统,共同完成特定任务。

该定义包含三个核心要素:与员工相关的特点、与机器人相关的特点以及环境特点。从员工因素来看,员工特质(性别、年龄、人格、信任倾向等)会影响其对机器人的信任,员工的能力素质(技能、经验、胜任力、感知力等)也会影响人机协作的效果(Hancock等,2011)。从协作机器人特点来看,机器人外在(拟人程度、行为等)以及内在(机器人种类、机器人人格、自动化程度、可靠性等)属性特征与人机协作的结果息息相关。环境特点包括交互情境(物理环境、文化特征等)、任务目标(任务种类、任务复杂性、任务数量等)以及交互过程(团队动态、交互沟通等)等。

三、人机协作对员工的影响回顾已有文献,人机协作的不同要素以及要素的不同配置都会影响人机协作的实施效果,本文将从心理和行为两个层面梳理归纳人机协作引起的员工反应。

(一)人机协作对员工心理状态的影响

已有研究发现,人机协作的实施会引发员工心理状态的变化,其中威胁感和信任感受到了最广泛的关注。人机协作对员工心理状态影响的研究大多从协作机器人的特点出发,也有学者探讨了员工及环境特点的影响。

1.协作机器人特点对员工心理状态的影响

(1)威胁感

任何个人都同时属于多个社会群体,如一定的种族群体、性别群体、宗教团体等,在最广泛的层面上,人们会将自身划分为人类群体,而将其他非人类实体看作外部群体。在人机交互中,尽管机器人并没有生命,但是人类确实认为机器人对人类群体构成了潜在威胁(Złotowski等,2017)。从这个角度出发,机器人作为外部群体主要从两个方面造成威胁:现实威胁和身份威胁(Riek等,2006)。

现实威胁是指对群体的物质资源、安全以及身体健康构成的威胁(Złotowski等,2017),人机协作的现实威胁主要包括直接就业、相关社会问题以及安全三个方面。人机协作最直接的威胁体现在人类工作上,机器人的普及将不可避免地替代一部分人类劳动力,影响人们的就业和工作,从而引发人们对工作问题的担忧。这种威胁不仅直接来自于失业,也涵盖了与工作相关的其他方面,包括工作关系、职业发展、福利待遇等,例如王才等(2019)发现工业机器人规模运用程度越高,员工的工作丧失不安全感、过度竞争不安全感以及薪酬晋升不安全感越大。人机协作对工作的影响还会进一步引发其他社会问题,例如劳动力结构和技能的变化、低技能工人的转型和再就业问题以及劳动关系的转型和治理问题等(许怡和叶欣,2020)。在安全方面,虽然现有协作机器人技术能够避免碰撞等事故,提高人机交互的安全性(Hentout等,2019),但随着机器人自动化和自主化水平的进一步提高,人们开始担心自主型机器人的安全性(Złotowski等,2017)。

身份威胁涉及对人类身份或独特性的一种更具有象征性的威胁(Złotowski等,2017),例如对群体独特性、价值观以及区别性的威胁(Riek等,2006)。人们倾向于将自己所属的群体看作与其他群体截然不同的积极群体(Tajfel和Turner,1986),但是机器人可能会模糊人类群体与机器人群体之间的界限,从而威胁人类群体的独特性(Złotowski等,2017)。已有研究主要从机器人外在特点以及内在性质两方面探讨其对人类的身份威胁。从外在特点的角度出发,人与机器人之间的情感互动会受到机器人各方面的影响,例如机器人的外观、表情、姿势、声音等(Goetz等,2003;Ku等,2005;Kulic和Croft,2007),机器人的外在特点会影响人们与其建立的情感联系,并对人们感知的机器人个性发挥关键作用(Hwang等,2013)。拟人化在机器人外观中的作用最为突出,一般来说,人们会认为机器人越像人类,其在沟通、智力等技能上表现越好,因此拟人程度高的机器人在人机协作中更具优势,但是机器人拟人程度对人类感知的影响并不呈线性,随着人类形态特征的增加,人们对机器人的熟悉程度存在逐渐上升—突然下降—重新上升的过程,这种现象就是Mori(1970)提出的神秘谷理论。Ferrari等(2016)研究发现,机器人拟人程度越高,人们感知的人与机器人模糊性就越高,机器人对人类身份的威胁也越大。机器人的内在性质也会影响人们的威胁感知,例如机器人的功能、个性、自动化程度等(Hwang等,2013;Złotowski等,2017)。Złotowski等(2017)发现与自动化程度低的机器人相比,自主型机器人被认为具有更高的威胁性,并且会引发更强烈的负面态度。

(2)信任感

为了使人机团队完成既定目标,人们必须相信一起合作的机器人会维护团队所有成员的利益(Hancock等,2011),人们对机器人的信任感会影响人机协作的效果。人机信任需要维持在一个适当的水平,过度依赖和滥用系统(人机信任程度高的情况下)或者完全不使用系统(人机信任程度低的情况下)都会降低人机协作的优势,产生负面后果(Lee和See,2004;Parasuraman和Manzey,2010;Parasuraman和Riley,1997)。例如,在不确定性高的环境中,强大的信息处理能力是机器人的固有优势,而对机器人的信任程度直接影响人们是否接受机器人提供的信息以及遵循机器人提供的建议(Freedy等,2007)。相比于机器人的拟人程度等外在属性,性能相关因素与人们对机器人的信任感关系更强,例如机器人的可靠性、错误率、故障率等(Hancock等,2011)。与人际信任类似,人机信任也受到外部因素的影响,这种信任感是动态的,会随着时间和环境的变化而变化(Hoff和Bashir,2015)。参考人与自动化信任研究,人们通常会对新兴自动化系统表现出积极的信任,但这种信任会随着系统发生错误而迅速衰退,可靠性和可预测性逐渐成为信任的主要基础(Madhavan和Wiegmann,2007)。

(3)其他心理认知

威胁感和信任感是人机协作对员工影响研究中主要的方面,随着人机协作的不断普及,机器人对人类个体其他方面的心理影响也得到了广泛探讨。机器人与人类个体的接触和互动会对个体的心理产生影响,例如人机互动中机器人的触摸行为会减弱个体的生理压力,对参与者的情绪状态产生有益影响,并增加个体与机器人之间的亲密感(Willemse和van Erp,2019)。此外,机器人对个体的影响可能是复杂的,Mahzoon等(2019)研究发现,机器人与个体的互动提高了个体对机器人感知思维的评价,并且提高了个体感知的与机器人的积极关系;有趣的是,尽管感知与机器人的关系更密切,个体对机器人的反应以及使用机器人的动机却没有显著增加。

2.员工特点及环境特点对员工心理状态的影响

现有研究多从机器人特点出发探讨人机协作对人们心理状态的影响,实际上个体对机器人的感知和情绪不仅受到机器人特征的影响,也与协作者自身的特征以及任务环境有关。

Rosenthal-Von Der Pütten和Weiss(2015)在研究神秘谷理论的适用性时发现,个体特征如性别、性格等会影响人机交互中个体对机器人的感知,即使个体一开始对机器人抱有消极态度,这种态度也可能因人机交互的实际体验而有所改善。Richert(2018)等研究发现,员工的性格会影响其对机器人的看法,进而影响人机协作团队建设。Hancock等(2011)通过元分析对已有文献进行整合,发现个体因素与人机信任的关系研究较为匮乏,现有研究结果显示两者的关系并不十分明显。他们指出,个体相关特征,包括已有工作经验、接受的培训、注意力、自信心以及其他个体因素,对于深入理解人机信任至关重要。

环境因素也影响着人们对机器人的感知,例如人们对机器人个性的感知与自身特定的性格预期有关,而这种性格预期又取决于机器人完成的任务以及文化背景(Rosenthal-Von Der Pütten和Weiss,2015)。Srite和Karahanna(2006)的研究表明,文化与人们对机器人的接受程度关系紧密,西方文化强调独立,更可能认为机器人会取代人类工作,从而将其视为威胁,接受程度较低,而东方文化强调相互依赖,更重视互助和互动,对机器人接受程度可能相对较高。Hancock等(2011)通过元分析发现,环境因素对人机信任有适度的影响,主要包括团队协作层面的组织成员关系、文化、沟通以及工作任务层面的任务种类等方面,但受限于研究数量难以得到更进一步的结论,团队共享心智模式、任务复杂性、多任务要求和物理环境可能也会影响人机信任。人与机器人的团队组成也会影响个体对机器人的感知,相比于群体外的人类,个体对群体内的机器人更抱有好感(Fraune等,2020)。

(二)人机协作对员工行为表现的影响

人机协作不仅会带来员工心理状态的变化,还会进一步引发不同的行为表现。人机协作可能引发员工积极的合作行为或消极的反生产行为,最终影响员工的工作绩效。例如,Vasalya等(2018)研究了一线员工与人形机器人共事时的绩效表现,结果表明一线员工的工作速度受到影响(生产效率与机器人的速度正相关),但是工作准确性没有受到明显的影响。de Visser和Parasuraman(2011)研究发现,不论机器人的可靠性如何,人机团队合作的绩效都高于单独的人或者机器人团队的绩效。基于文献回顾和梳理,本文从人机协作的不同要素以及要素的不同配置归纳人机协作对员工行为的影响。

1.协作机器人特点对员工行为表现的影响

协作机器人的外观和动作对员工的行为表现具有重要影响。机器人的外形与人们对其的接受程度密切相关,并影响着人们后续是否持续协作(Odette等,2017)。在机器人的表情、动作方面,机器人的微笑、凝视等动作可以提升协作者与其的情感联系,进而促进人们积极的合作行为(Papadopoulos等,2016)。机器人的交流行为也有助于改善人们对机器人的负面态度,机器人的语言或非语言行为与人机交互有关(Thepsoonthorn等,2018)。在人机交互中,机器人的类人行为对绩效结果有更大的影响,而在评估机器人的稳定特征(如“有头脑”)时,机器人的类人外观更为重要(Abubshait和Wiese,2017)。协作机器人的性能和属性对员工行为表现的影响可能更加持久。Abubshait和Wiese(2017)研究发现,即使在一开始机器人的外观引起了人们的积极期望,但是如果后续机器人的实际表现并没有达到这种期望,那么外观产生的积极影响就不能持续,不利于员工持续的协作行为,进而对人机协作产生有害的影响。

2.员工特点对员工行为表现的影响

员工自身特点使得他们的行为表现以及参与人机协作的效果有所差异。性别、年龄会影响人们对机器人的接受度(Rosenthal-Von Der Pütten和Weiss,2015),但是已有研究的结果并不一致,例如在生活领域,很多人对辅助机器人在儿童以及老人中的应用持消极态度(Savela等,2018),但有研究表明老年人和护理人员都倾向于使用机器人,并且老年人会认为机器人有助于交流(Jenkins和Draper,2015;Koceski和Koceska,2016)。人格以及先前经历等个体特征也与协作者的满意度和任务绩效有关(Thepsoonthorn等,2018),例如关于机器人凝视和点头的非语言行为,内向的个体更喜欢机器人的点头行为而非凝视行为,与之相反,外向的个体更喜欢机器人的凝视行为,但是研究中外向组和内向组对机器人的喜爱和互动行为却存在矛盾。Papadopoulos等(2016)在研究机器人的凝视行为模式时发现人们的整体凝视行为模式表现出明显的个体间差异。员工的技能与经验很大程度上决定了人机协作的实施效果,尤其在工业企业,员工的培训和发展是关键主题(Charalambous等,2015)。员工发展是先进制造技术(AMT)实施的关键,员工的经验和技能可以促进其对设备的有效使用并促进组织绩效的提升(Chung,1996)。关于以往生产活动实施(如准时生产)的实证研究表明,员工培训和教育是生产活动成功实施的关键因素(Fraser等,2007;Singh等,2007)。

3.环境特点对员工行为表现的影响

员工所处的工作环境,包括工作空间、职场环境、任务特点以及社会文化,都会影响人机协作中员工的行为表现。人机交互的物理空间会影响协作者的体验和行为。相比于人们面对机器人的背面,人与机器人正面相对有利于协作者花费更多的时间和注意力在机器人上,从而促进人们的交互参与(Papadopoulos等,2016)。Kim和Multu(2014)研究发现,机器人与用户之间的空间距离会影响用户的表现,在机器人担任主管的研究中,参与者在人机距离近的时候会获得更加积极的体验,而当机器人处于下属地位时,参与者则希望人机距离更远;当机器人与参与者合作时,人们更倾向于与机器人保持较远的距离,当机器人与参与者竞争时则相反。此外,这种影响不一定直接来自于空间位置的变化,例如新技术的实施使得工作场所的社会环境发生变化,员工感受到较大的不确定性(Terry和Jimmieson,2003),从而产生阻碍组织变革等反生产行为。组织氛围和社会文化在人机协作的实施中也被视作重要的影响因素(Charalambous等,2015)。社交和任务参与都对协作过程起着重要作用(Papadopoulos等,2016)。参考以往技术变革相关研究中的自动化技术研究,由于自动化技术的实施不可避免地会增加操作的不确定性,员工需要得到授权做出决策来提升工作能力以完成任务(Wall等,2002),因此决策的去中心化更有利于先进制造技术的实施(Griffin等,2007)。高层管理者对新技术的承诺和支持也是先进制造技术和精益技术成功实施的关键因素(Klein等,2001;Worley和Doolen,2006)。

(三)员工心理状态在人机协作与员工行为表现之间的中介作用

综合已有研究,本文从心理状态和行为表现两个方面梳理总结人机协作对员工反应的影响,实际上人们的心理状态和行为表现并不是完全相互独立的,在很多情况下,员工的心理状态在人机协作的实施与员工行为表现之间可能起中介作用。例如,Terry和Jimmieson(2003)指出,组织变革的很大一部分涉及技术创新,新技术带来的工作环境的变化以及员工的不确定性心理会增加员工的焦虑和恐惧,进而与其他负面后果联系在一起,如更高的工作压力(Schweiger和Denisi,1991)、离职意愿以及更低的工作满意度(Bastien,1987;Johnson等,1996)。Papadopoulos等(2016)研究发现,机器人与人类面对面交互以及机器人的凝视、微笑等动作可以改善社会情感联系,促进用户对机器人的情感依恋,从而提升人机交互和协作的效果。

人机协作对员工心理和行为的影响是一个动态过程,人们对机器人的情感和感知会随着外部环境的变化以及协作过程的推进而出现转变,个体自身也会调整行为以更好地应对协作任务。人类倾向于高效地彼此互动(Kuster和Kappas,2014),协作本身可能影响人们的参与程度(Papadopoulos等,2016),在人与机器人的交互中,协作者体验到的参与程度会影响他们准备为协作付出的努力程度,并最终影响他们是继续还是停止协作行为的决定。

四、人机协作对员工影响的理论解释(一)相关理论

此部分将重点阐述已有研究涉及的人机协作相关理论。

1.神秘谷理论

Mori(1970)提出了神秘谷(uncanny valley)理论,该理论假设机器人拟人化外观和人类接受度之间存在非线性关系:机器人在外观和动作上越接近人类,人们对机器人的情感反应就越积极,但是这种积极影响在到达某个点之后就会急剧下降并降到谷底,人们对机器人的反应迅速变得消极,而当机器人的拟人程度进一步增加时,人们的情感反应又会回到正面。神秘谷理论指出了机器人拟人程度对人类感知的影响,以此为基础,很多人机交互研究探讨了类人机器人导致人们负面情绪的原因。尽管神秘谷理论影响很大,但仍缺少全面的实验证明(Rosenthal-Von Der Pütten和Weiss,2015)。未来的研究可以站在更广泛的角度,检验与机器人互动的个体特征、机器人的行为以及任务背景等对机器人外观与人类接受度关系产生的潜在影响。

2.社会身份认同理论

社会身份(social identity)指的是“个体基于自身认知所属社会类别而产生的自我形象”(Tajfel和Turner,1986)。社会身份认同理论认为,人们会努力实现并保持积极的社会身份认同,而这种积极的社会身份认同来源于个体所属群体与外部群体之间的比较(Tajfel和Turner,1979),如果所属群体与外部群体相似性太高,这种相似性就会破坏群体之间的界限并挑战群体的独特性,从而使人们产生威胁感(Jetten等,1996)。现有研究大多将机器人群体作为外部群体来与人类群体相比较,关注机器人的外形、性格、功能等对人们社会身份认知的影响。例如,机器人具有下棋等功能会挑战人类在技能方面的独特性(Kaplan,2004)。未来的研究可以进一步检验人们对机器人的感知并识别人们担心机器人对人类身份产生影响的具体方面。

3.个人—环境匹配理论

个人—环境匹配理论(person-environment fit theory)从人与环境交互的视角出发,认为个体的态度和行为是由个体及其所处的环境共同决定的(Edwards,1996)。个体特征与环境特征的契合会促进个人—环境匹配(Kristof-Brown等,2005),这种匹配会提高个体活跃度,影响员工的绩效、满意度和离职倾向等。已有研究主要探讨了个人—环境匹配对个体的影响,例如个人—环境的不契合可能引发员工的消极情绪,进而导致员工的反生产行为(Harold等,2016)。人机协作可能在物理空间和文化氛围上造成环境的变化(Fraser等,2007),影响员工与环境的契合度。未来关于人机协作中环境特征对员工影响的研究,可以从个人—环境匹配的角度寻找切入点,个人—环境匹配理论中个体与环境相互影响的动态过程对人机交互中协作者持续的心理和行为变化可能也具有一定的解释力。

4.不确定性—认同理论

不确定性—认同理论(uncertainty-identity theory)关注个体身份相关不确定感如何激发个体对社会群体的认同。Hogg等人在社会身份认同理论和自我归类理论的基础上,进一步明确了自我不确定感、群体认同和群体行为概念并深化了它们之间的关系,指出了个体在体验到不确定感之后的心理过程和应对机制(Hogg,2021;Hogg和Adelman,2013)。未来的研究可以关注员工在人机协作中不确定感的变化,具体来说,员工在感知到机器人或人机协作引起环境变化的不确定后,会经历怎样的心理过程,以及员工是否会通过自我归类来明确身份,增强归属感,以降低不确定感。

5.依恋理论

依恋理论(attachment theory)关注个体与其重要的人之间距离和亲密度的平衡感知(Ainsworth和Bowlby,1991),经常被用于解释个体与他人之间情感连接的本质(Smith等,1999)。Bowlby(1970)从依恋理论出发,在机器人协助学生学习的研究中发现社会情感联系在人机协作学习过程中具有重要意义。Feldman(2007)考察了微观社会行为背景下的附属社会联系,发现凝视、触摸等微观行为将个体联系在一起。具有移情性的机器人可能通过社会情感纽带促进人机协作学习中学习者的参与(Castellano等,2013)。未来的研究可以继续关注人机协作的环境,探索不同场景下人与机器人的情感联系。

6.思想感知理论

思想感知(mind perception)理论认为人类主要基于两种属性推断其他实体拥有无形的、与人类类似的思想(Gray等,2007),一种是实体对象的能动性(如思考、推理、实现自身目标的能力等),另一种是实体对象的体验性(如拥有感觉的能力)。基于思想感知理论的观点,被评估实体即使是非人类目标,如机器人,在一些情况下也会被认为拥有与人类相似的思维(Fink,2012;Vogeley和Bente,2010)。现有研究主要从思想感知理论的视角解释人们对机器人产生威胁感的原因,考察思想感知在机器人特性与协作者心理行为表现中的作用,如Quadflieg等(2016)关注机器人思维表现与人们感知情绪的关系。未来的研究可以从思想感知的两个维度探讨人们对不同类型机器人的心理感知。

7.认知失调理论

认知失调(cognitive dissonance)是人们发现自己持有的想法、观念或价值观不一致时所体验到的心理不适的感觉(Cooper,2007)。认知失调不仅产生于人们持有多个存在冲突的想法时,人们在发现新的事件或信息与他们已经持有的想法、观念或价值观存在冲突时,也会出现认知失调。从这个角度出发可以解释人们对机器人的态度转变。Gray和Wegner(2012)认为,人们对机器人的恐惧和安全担忧可能产生于他们对人和机器人的不同期望,人们通常认为人类和机器人都是聪明的,但是情感是人类特有的(Gray等,2007),当人们开始感知机器人具有情感时,他们对机器人的心理预期就会被打破并出现认知失调。认知失调理论指出人们在产生心理不适后可能改变自己的观念或行为以促进一致,未来可以进一步研究人们对机器人的长期心理和行为变化。

8.归因理论

归因理论(attribution theory)关注个体如何对自身以及他人的行为结果进行解释(Kelly和Michela,1980;Weiner,1985),以及这种解释如何影响后续的情感和行为反应。人们用于结果解释的因素有两大类:外部环境因素和个体内部因素(Rotter,1966)。人们在进行解释时也会存在一些偏差,一种归因偏差是“自利性归因偏差”(self-serving bias),即人们倾向于将积极结果归因于内部因素而将消极结果归因于外部因素(Bradley,1978;Miller和Ross,1975)。归因理论与人机协作并没有直接的联系,但在解释人机协作中的合作或反生产行为时可能提供启示,例如员工可能在感到压力时将压力归因于外部因素(Martinko等,2002),从而产生消极工作等反生产行为。未来的研究可以关注归因理论对员工人机协作行为的解释力,提出人机协作的实践建议。

9.社会交换理论

社会交换(social exchange)理论的基本假设是人们需要资源来生存,而其他人可以提供资源,共享和交易资源是关系的重要方面(Fox和Gambino,2021)。社会交换理论关注人们如何在获得回报的预期下产生并维持与他人的交换关系(Blau,1964)。Krämer等(2012)提出的社会交换观点也可以作为理解人机关系的有效基础,但现在拟人机器人特性可能会挑战已有的假设和主张(Fox和Gambino,2021)。社会交换理论也可以解释一些员工行为,例如工作中员工们正式或非正式的关系对信息和资源交换是重要的(Sherony和Green,2002),但在部分特殊工作环境中,员工难以获得真正的社会联系(Lam和Lau,2012),资源交换的缺乏可能导致员工绩效的降低。未来的研究可以关注社会交换在人机关系中的存在程度,以及机器人普及后员工是否会感到资源交换(特别是社会资源交换)的缺乏,探讨其对员工的影响。

(二)理论总结与评析

从不同理论解释的内容出发,上述九种理论都可以用来解释人机协作对员工心理或行为的影响。其中,神秘谷理论针对的是机器人拟人程度与人类接受度的非线性关系,思想感知理论关注人们对机器人思维的感知,尚需要进一步的验证和讨论。其他理论大多是已有人际理论,人机协作研究借鉴这些理论展开。社会身份认同理论、不确定性—认同理论和认知失调理论主要解释人们在人机协作中可能产生的身份认知上的变化,个人—环境匹配理论从人与环境匹配的角度考察协作环境对员工的影响,依恋理论则用于解释人们对机器人的情感变化。归因理论和社会交换理论更多用于解释人机协作过程中员工动态的心理和行为变化。现有研究的理论使用如图1所示,部分理论是相互补充的(如社会身份认同理论、不确定性—认同理论),并且这些理论可能适用于解释不同的影响关系(人机协作—心理状态、人机协作—行为表现以及心理状态—行为表现)。

|

| 图 1 人机协作研究的理论使用场景及研究框架 |

从理论使用的角度出发,人机协作在心理学、管理学等领域的研究大多忽略了理论,仅停留在“就事论事”阶段,基于理论进行的应用研究尚处于起步阶段。理论在管理学相关研究中具有至关重要的作用,合适的理论可以为人机协作的研究过程提供指导,帮助研究者提出假设、构建模型并解释结果。因此,研究者们应该仔细考虑研究人机关系时所选择和使用的理论(Fox和Gambino,2021)。在使用现有理论时,一方面,学者们可以对现有理论进行修改或拓展并进行测试。通过考察相关变量,如感知代理和行为拟人化等,拓宽现有人际理论的范围和解释力,以适应人机交互实际(Fox和Gambino,2021)。另一方面,学者们可以使用现有人际理论考察人机协作过程中以及人机协作后个体与其他员工、领导者等的人际关系变化,例如,员工在与机器人共同工作后,是否会与其他员工进行“补偿式”的人际交流,这类研究具有很强的现实意义,有助于企业制定可行的实践措施。

五、结论、启示与展望(一)研究结论

人机协作是很多行业发展的重要趋势,相关研究有助于深入理解人机协作对员工的影响并为企业实践提供亟需的指导意见。通过对已有文献的梳理和总结,本文首先厘清了人机协作的概念内涵,提出了人机协作的三个核心要素,即与员工、机器人以及环境相关的特点;其次,基于人机协作的三个要素对已有研究进行了归纳总结,提出了人机协作三个要素对员工心理状态和行为表现两个方面影响的研究框架(参见图1);再者,系统介绍和总结了已有研究主要涉及的九种理论,讨论了理论的应用场景和使用方式。

(二)理论贡献与实践启示

本研究的理论贡献主要体现在三个方面:第一,系统梳理了人机交互研究的发展,并厘清了人机协作的概念内涵。第二,虽然已有研究识别了很多人机协作的影响因素和影响结果,但是对这些因素的类别、层次未能较好地进行区分与梳理(Charalambous等,2015;Hancock等,2011)。本文归纳了人机协作的三要素,借此丰富了人机协作的内涵,为以后的研究提供了切入视角。本文基于内涵的三要素,相对完整地展现了人机协作要素与员工心理、行为的关系以及变量间可能的逻辑链条,构建了人机协作对员工影响的分析框架,有助于研究者对已有研究形成清晰、系统的认识,进一步推动相关领域的研究。第三,本文归纳和评析了现有人机协作研究的理论视角,如神秘谷理论(Mori,1970)、思想感知理论(Gray等,2007)等,不仅有助于为后续研究提供理论参考,也可能为学者们构建新理论提供启示。

本文对于企业推进人机协作也有重要的实践启示。第一,企业可以通过识别人机协作的影响因素,在引入机器人时提高员工的接受程度。例如,企业在引入机器人时需要注意所选择机器人的外观、摆放位置以及与协作者的交互方式等(Odette等,2017;Papadopoulos等,2016),帮助员工学习必要的知识和技能(Hancock等,2011),减少员工的担忧等负面心理,以利于人机协作的开展。第二,根据人机协作的动态过程调整管理措施。人机协作的影响是动态的(Papadopoulos等,2016),企业可以在推进机器人使用的过程中采取一些管理措施,例如调整主管的管理方式、完善员工的职业生涯保障、强化高层领导者的相关承诺和支持等,以减少人机协作可能带来的负面效应,促使员工实施企业期待的行为。第三,加强人机协作中员工心理状态的管理。例如畅通沟通和反馈渠道,及时关注协作员工的情绪和行为反应,了解员工的需求变化并进行相应的改进,促进员工与机器人、员工之间的和谐关系,促使人机协作持续发挥积极作用。

(三)未来研究展望

当前关于人机协作对员工影响的研究还比较少,随着企业数字化转型的进一步深入以及机器人使用场景的不断拓展,人机协作将受到学术界和实践界更广泛的关注。基于现有成果,本文认为未来可以从影响因素和影响结果、影响机制、理论与量表研究以及其他影响主体四个方面对人机协作进行更全面和深入的研究。

1.进一步探讨人机协作对员工的影响因素和影响结果

首先,在影响因素方面,机器人、协作者和环境因素都会对员工产生影响。从机器人的角度出发,已有研究表明机器人的外观和性能会对员工产生影响(如Ferrari等,2016),未来可以对机器人的其他因素进行深入的探讨,如机器人的交流方式、机器人的自动化程度、柔性程度等。从协作者的角度出发,现有研究发现员工的性别、性格等方面差异会影响人机协作的效果,如Richert(2018)等指出不同性格的员工对机器人的态度存在差异并会影响人机团队建设,未来有必要从员工的技能和经验、个体的信任倾向等视角进行研究(Hancock等,2011)。从环境角度探析的研究大多理论性地探讨工作场所和社会文化因素对人机协作的影响(如Charalambous等,2015;Papadopoulos等,2016),未来可以采取实证范式进一步挖掘这些因素对人机协作的影响程度。此外,未来还可以探讨团队或组织层面的环境因素对人机协作的影响,例如领导者的管理行为、组织支持氛围等。

其次,在影响结果方面,人机协作对员工的影响是广泛的。以往的研究更多地关注人机协作的影响因素,而关于影响结果的探究主要集中于心理层面的员工信任感和威胁感以及行为层面的反生产行为等(如Hancock等,2011;Złotowski等,2017),未来的研究可以进一步探索人机协作对员工积极心理状态和行为表现的影响。例如,引入机器人替代人类进行重复乏味的工作,可能减少协作员工心理资源损耗以及增加工作旺盛感等。

2.加强人机协作影响机制研究

首先,应关注人机协作产生影响的中介机制。已有研究已经识别了人机协作对员工产生影响的前因和结果变量,但是对各变量之间的具体作用机制尚缺乏充分的分析和解释(Hancock等,2011)。本文梳理了人机协作对员工的影响因素和影响结果,并构建了初步的理论分析框架,未来的研究可以对具体的中介作用机制及中介路径差异进行进一步的理论探讨和实证分析。

其次,应加强人机协作产生影响的边界条件研究。现有研究通常单独从人机协作的某种要素出发,探究其对员工的影响,然而得到的结果可能存在一些差异,例如机器人会对员工产生现实威胁(王才等,2019),但协作员工自身的工作经验和技能等差异可能会调节人机协作和员工威胁感之间的关系。同时,工作的特性(如常规工作和创新工作)可能会调节人机协作与员工反应之间的关系。未来的研究有必要在这些方面加强探析。

最后,未来的研究还应该关注人机协作中员工协作意愿和行为的动态变化。人机协作实际上是一个动态的过程,协作过程中机器人、协作者和环境的变化会影响员工后续协作的意愿和行为(Papadopoulos等,2016)。例如,机器人性能的可靠性正向影响协作者的信任感(Hancock等,2011),当机器人出现性能故障时,协作者的协作意愿和行为会产生动态变化,这方面还缺乏深入的研究。此外,机器人的普及会影响员工的人际互动,但是如果企业采取团建活动,员工的人机协作意愿和行为可能又会有进一步的变化。人机协作的动态过程研究具有重要的现实意义,相关研究发现有助于企业持续进行适配性调整以发挥人机协作的优势。

3.拓展和创新理论基础,完善概念的操作性定义并开发测量工具

在人机协作中,员工协作的对象是机器人,这在一定程度上挑战了原有人际相关理论的前提假设,使得相关理论可能无法很好地解释人机协作现象。未来的研究可以进一步拓展现有理论的适用范围,例如,在一定程度上将机器人视作人类,进而探索拟人化情境下人机协作对员工的影响。此外,学者们可以将机器人视为与人类截然不同的实体,尝试开发建立在人—机器人关系基础上的新理论(Bigman等,2019;Dautenhahn,2008)。构建新理论将有助于更深入地理解人机协作的影响。

在已有的人机协作文献中,部分影响因素和影响结果仅停留在理论性定义阶段,相关研究并未进一步提出具体的操作性定义和量表。例如,身份威胁、人机亲密等。为了加强人机协作相关研究的解释力和可复制性,未来有必要对相关概念进行清晰的操作性定义,并按照规范的流程进行量表编制和实证检验,推进人机协作影响的实证研究。

4.关注人机协作对更高层次主体的影响

已有研究主要关注人机协作对直接协作者的影响(如Hentout等,2019),实际上人机协作的普及也会影响更高层次的主体,包括领导者、组织等。人机协作对不同层次主体会产生怎样的影响?这些影响又有什么差异?这些问题都需要未来的研究给予更多的关注。例如,从领导者的角度出发,人机协作的应用可能使得领导者的一些管理方式失效,领导者应该做出哪些转变以调动员工的积极性?从组织的角度出发,人机协作会对组织结构、组织变革等产生什么影响?为应对这些影响,组织需要做出哪些转变?在转变的过程中需要注意什么?人机协作情境下的权力和责任分配应当如何调整?这些关于人机协作对更高层次主体影响及组织应对的问题都值得更深入的探讨。

| [1] | 李磊, 王小霞, 包群. 机器人的就业效应: 机制与中国经验[J]. 管理世界, 2021, 37(9): 104–118. |

| [2] | 孙新波, 张媛, 王永霞, 等. 数字价值创造: 研究框架与展望[J]. 外国经济与管理, 2021, 43(10): 35–49. |

| [3] | 王才, 周文斌, 赵素芳. 机器人规模应用与工作不安全感——基于员工职业能力调节的研究[J]. 经济管理, 2019, 41(4): 111–126. |

| [4] | 许怡, 叶欣. 技术升级劳动降级?——基于三家“机器换人”工厂的社会学考察[J]. 社会学研究, 2020, 35(3): 23–46. |

| [5] | Abubshait A, Wiese E. You look human, but act like a machine: Agent appearance and behavior modulate different aspects of human-robot interaction[J]. Frontiers in Psychology, 2017, 8: 1393. |

| [6] | Ajoudani A, Zanchettin A M, Ivaldi S, et al. Progress and prospects of the human-robot collaboration[J]. Autonomous Robots, 2018, 42(5): 957–975. |

| [7] | Bastien D T. Common patterns of behavior and communication in corporate mergers and acquisitions[J]. Human Resource Management, 1987, 26(1): 17–33. |

| [8] | Bigman Y E, Waytz A, Alterovitz R, et al. Holding robots responsible: The elements of machine morality[J]. Trends in Cognitive Sciences, 2019, 23(5): 365–368. |

| [9] | Bitonneau D, Moulières-Seban T, Dumora J, et al. Design of an industrial human-robot system through participative simulations-tank cleaning case study[A]. Proceedings of 2017 IEEE/SICE international symposium on system integration[C]. Taipei, China: IEEE, 2017. |

| [10] | Blau P M. Exchange and power in social life[M]. New York: John Wiley & Sons, 1964. |

| [11] | Bowlby J. Disruption of affectional bonds and its effects on behavior[J]. Journal of Contemporary Psychotherapy, 1970, 2(2): 75–86. |

| [12] | Bradley G W. Self-serving biases in the attribution process: A reexamination of the fact or fiction question[J]. Journal of Personality and Social Psychology, 1978, 36(1): 56–71. |

| [13] | Castellano G, Paiva A, Kappas A, et al. Towards empathic virtual and robotic tutors[A]. Proceedings of the 16th international conference on artificial intelligence in education[C]. Memphis: Springer, 2013. |

| [14] | Chandrasekaran B, Conrad J M. Human-robot collaboration: A survey[A]. Proceedings of SoutheastCon 2015[C]. Fort Lauderdale: IEEE, 2015. |

| [15] | Charalambous G, Fletcher S, Webb P. Identifying the key organisational human factors for introducing human-robot collaboration in industry: An exploratory study[J]. The International Journal of Advanced Manufacturing Technology, 2015, 81(9-12): 2143–2155. |

| [16] | Chung C A. Human issues influencing the successful implementation of advanced manufacturing technology[J]. Journal of Engineering and Technology Management, 1996, 13(3-4): 283–299. |

| [17] | Cooper J M. Cognitive dissonance: 50 years of a classic theory[M]. Thousand Oaks, CA: SAGE Publications Ltd, 2007. |

| [18] | Dautenhahn K. Methodology & themes of human-robot interaction: A growing research field[J]. International Journal of Advanced Robotic Systems, 2008, 4(1): 103–108. |

| [19] | de Visser E, Parasuraman R. Adaptive aiding of human-robot teaming[J]. Journal of Cognitive Engineering and Decision Making, 2011, 5(2): 209–231. |

| [20] | Fang H C, Ong S K, Nee A Y C. A novel augmented reality-based interface for robot path planning[J]. International Journal on Interactive Design and Manufacturing, 2014, 8(1): 33–42. |

| [21] | Feldman R. Parent-infant synchrony and the construction of shared timing; physiological precursors, developmental outcomes, and risk conditions[J]. Journal of Child Psychology and Psychiatry, 2007, 48(3-4): 329–354. |

| [22] | Ferrari F, Paladino M P, Jetten J. Blurring human-machine distinctions: Anthropomorphic appearance in social robots as a threat to human distinctiveness[J]. International Journal of Social Robotics, 2016, 8(2): 287–302. |

| [23] | Fink J. Anthropomorphism and human likeness in the design of robots and human-robot interaction[A]. Proceedings of the 4th international conference on social robotics[C]. Chengdu: Springer, 2012. |

| [24] | Fox J, Gambino A. Relationship development with humanoid social robots: Applying interpersonal theories to human-robot interaction[J]. Cyberpsychology, Behavior, and Social Networking, 2021, 24(5): 294–299. |

| [25] | Fraser K, Harris H, Luong L. Improving the implementation effectiveness of cellular manufacturing: A comprehensive framework for practitioners[J]. International Journal of Production Research, 2007, 45(24): 5835–5856. |

| [26] | Fraune M R, Šabanović S, Smith E R. Some are more equal than others: Ingroup robots gain some but not all benefits of team membership[J]. Interaction Studies, 2020, 21(3): 303–328. |

| [27] | Freedy A, DeVisser E, Weltman G, et al. Measurement of trust in human-robot collaboration[A]. Proceedings of 2007 international symposium on collaborative technologies and systems[C]. Orlando: IEEE, 2007. |

| [28] | Goetz J, Kiesler S, Powers A. Matching robot appearance and behavior to tasks to improve human-robot cooperation[A]. Proceedings of the 12th IEEE international workshop on robot and human interactive communication[C]. Millbrae: IEEE, 2003. |

| [29] | Gray H M, Gray K, Wegner D M. Dimensions of mind perception[J]. Science, 2007, 315(5812): 619. |

| [30] | Gray K, Wegner D M. Feeling robots and human zombies: Mind perception and the uncanny valley[J]. Cognition, 2012, 125(1): 125–130. |

| [31] | Griffin M A, Neal A, Parker S K. A new model of work role performance: Positive behavior in uncertain and interdependent contexts[J]. Academy of Management Journal, 2007, 50(2): 327–347. |

| [32] | Hancock P A, Billings D R, Schaefer K E, et al. A meta-analysis of factors affecting trust in human-robot interaction[J]. Human Factors: The Journal of the Human Factors and Ergonomics Society, 2011, 53(5): 517–527. |

| [33] | Harold C M, Oh I S, Holtz B C, et al. Fit and frustration as drivers of targeted counterproductive work behaviors: A multifoci perspective[J]. Journal of Applied Psychology, 2016, 101(11): 1513–1535. |

| [34] | Hentout A, Aouache M, Maoudj A, et al. Human-robot interaction in industrial collaborative robotics: A literature review of the decade 2008-2017[J]. Advanced Robotics, 2019, 33(15-16): 764–799. |

| [35] | Hoff K A, Bashir M. Trust in automation: Integrating empirical evidence on factors that influence trust[J]. Human Factors: The Journal of the Human Factors and Ergonomics Society, 2015, 57(3): 407–434. |

| [36] | Hogg M A. Self-uncertainty and group identification: Consequences for social identity, group behavior, intergroup relations, and society[J]. Advances in Experimental Social Psychology, 2021, 64: 263–316. |

| [37] | Hogg M A, Adelman J. Uncertainty-identity theory: Extreme groups, radical behavior, and authoritarian leadership[J]. Journal of Social Issues, 2013, 69(3): 436–454. |

| [38] | Hvilshøj M, Bøgh S, Nielsen O S, et al. Autonomous industrial mobile manipulation (AIMM): Past, present and future[J]. Industrial Robot, 2012, 39(2): 120–135. |

| [39] | Hwang J, Park T, Hwang W. The effects of overall robot shape on the emotions invoked in users and the perceived personalities of robot[J]. Applied Ergonomics, 2013, 44(3): 459–471. |

| [40] | Isma A, Brahim B. Time-dependant trajectory generation for tele-operated mobile manipulator[A]. Proceedings of the 3rd international conference on control, engineering & information technology (CEIT 2015)[C]. Tlemcen: IEEE, 2015. |

| [41] | Jenkins S, Draper H. Care, monitoring, and companionship: Views on care robots from older people and their carers[J]. International Journal of Social Robotics, 2015, 7(5): 673–683. |

| [42] | Jetten J, Spears R, Manstead A S R. Intergroup norms and intergroup discrimination: Distinctive self-categorization and social identity effects[J]. Journal of Personality and Social Psychology, 1996, 71(6): 1222–1233. |

| [43] | Johnson J R, Bernhagen M J, Miller V, et al. The role of communication in managing reductions in work force[J]. Journal of Applied Communication Research, 1996, 24(3): 139–164. |

| [44] | Kaplan F. Who is afraid of the humanoid? Investigating cultural differences in the acceptance of robots[J]. International Journal of Humanoid Robotics, 2004, 1(3): 465–480. |

| [45] | Kim Y, Mutlu B. How social distance shapes human-robot interaction[J]. International Journal of Human-Computer Studies, 2014, 72(12): 783–795. |

| [46] | Klein K J, Conn A B, Sorra J S. Implementing computerized technology: An organizational analysis[J]. Journal of Applied Psychology, 2001, 86(5): 811–824. |

| [47] | Koceski S, Koceska N. Evaluation of an assistive telepresence robot for elderly healthcare[J]. Journal of Medical Systems, 2016, 40(5): 121. |

| [48] | Krämer N C, von der Pütten A, Eimler S. Human-agent and human-robot interaction theory: Similarities to and differences from human-human interaction[A]. Zacarias M, Oliveira J V. Human-computer interaction: The agency perspective[M]. Berlin: Springer, 2012. |

| [49] | Ku J, Jang H J, Kim K U, et al. Experimental results of affective valence and arousal to avatar’s facial expressions[J]. Cyberpsychology & Behavior, 2005, 8(5): 493–503. |

| [50] | Kulic D, Croft E A. Affective state estimation for human-robot interaction[J]. IEEE Transactions on Robotics, 2007, 23(5): 991–1000. |

| [51] | Kuster D, Kappas A. What could a body tell a social robot that it does not know?[A]. Proceedings of international conference on physiological computing systems[C]. Lisbon: SciTePress, 2014. |

| [52] | Lee J D, See K A. Trust in automation: Designing for appropriate reliance[J]. Human Factors: The Journal of the Human Factors and Ergonomics Society, 2004, 46(1): 50–80. |

| [53] | Madhavan P, Wiegmann D A. Similarities and differences between human-human and human-automation trust: An integrative review[J]. Theoretical Issues in Ergonomics Science, 2007, 8(4): 277–301. |

| [54] | Mahzoon H, Ogawa K, Yoshikawa Y, et al. Effect of self-representation of interaction history by the robot on perceptions of mind and positive relationship: A case study on a home-use robot[J]. Advanced Robotics, 2019, 33(21): 1112–1128. |

| [55] | Martinko M J, Gundlach M J, Douglas S C. Toward an integrative theory of counterproductive workplace behavior: A causal reasoning perspective[J]. International Journal of Selection and Assessment, 2002, 10(1-2): 36–50. |

| [56] | Miller D T, Ross M. Self-serving biases in the attribution of causality: Fact or fiction?[J]. Psychological Bulletin, 1975, 82(2): 213–225. |

| [57] | Mori M. The uncanny valley[J]. Energy, 1970, 7(4): 33–35. |

| [58] | Odette K, Rivera J, Phillips E K, et al. Robot self-assessment and expression: A learning framework[J]. Proceedings of the Human Factors and Ergonomics Society Annual Meeting, 2017, 61(1): 1188–1192. |

| [59] | Papadopoulos F, Küster D, Corrigan L J, et al. Do relative positions and proxemics affect the engagement in a human-robot collaborative scenario?[J]. Interaction Studies, 2016, 17(3): 321–347. |

| [60] | Parasuraman R, Manzey D H. Complacency and bias in human use of automation: An attentional integration[J]. Human Factors: The Journal of the Human Factors and Ergonomics Society, 2010, 52(3): 381–410. |

| [61] | Parasuraman R, Riley V. Humans and automation: Use, misuse, disuse, abuse[J]. Human Factors: The Journal of the Human Factors and Ergonomics Society, 1997, 39(2): 230–253. |

| [62] | Quadflieg S, Ul-Haq I, Mavridis N. Now you feel it, now you don’t[J]. Interaction Studies, 2016, 17(2): 211–247. |

| [63] | Richert A, Müller S, Schröder S, et al. Anthropomorphism in social robotics: Empirical results on human-robot interaction in hybrid production workplaces[J]. Ai & Society, 2018, 33(3): 413–424. |

| [64] | Riek B M, Mania E W, Gaertner S L. Intergroup threat and outgroup attitudes: A meta-analytic review[J]. Personality and Social Psychology Review, 2006, 10(4): 336–353. |

| [65] | Rosenthal-Von Der Pütten A, Weiss A. The uncanny valley phenomenon: Does it affect all of us?[J]. Interaction Studies, 2015, 16(2): 206–214. |

| [66] | Savela N, Turja T, Oksanen A. Social acceptance of robots in different occupational fields: A systematic literature review[J]. International Journal of Social Robotics, 2018, 10(4): 493–502. |

| [67] | Schmidtler J, Knott V, Hölzel C, et al. Human centered assistance applications for the working environment of the future[J]. Occupational Ergonomics, 2015, 12(3): 83–95. |

| [68] | Schweiger D M, Denisi A S. Communication with employees following a merger: A longitudinal field experiment[J]. The Academy of Management Journal, 1991, 34(1): 110–135. |

| [69] | Sherony K M, Green S G. Coworker exchange: Relationships between coworkers, leader-member exchange, and work attitudes[J]. Journal of Applied Psychology, 2002, 87(3): 542–548. |

| [70] | Singh R K, Garg S K, Deshmukh S G, et al. Modelling of critical success factors for implementation of AMTs[J]. Journal of Modelling in Management, 2007, 2(3): 232–250. |

| [71] | Smith E R, Murphy J, Coats S. Attachment to groups: Theory and management[J]. Journal of Personality and Social Psychology, 1999, 77(1): 94–110. |

| [72] | Srite M, Karahanna E. The role of espoused national cultural values in technology acceptance[J]. MIS Quarterly, 2006, 30(3): 679–704. |

| [73] | Tajfel H, Turner J. An integrative theory of intergroup conflict[A]. Austin W G, Worchel S. The social psychology of intergroup relations[M]. Monterey: Brooks/Cole, 1979. |

| [74] | Tajfel H, Turner J C. The social identity theory of intergroup behavior[A]. Worchel S, Austin W G. Psychology of intergroup relations[M]. Chicago: Nelson Hall, 1986. |

| [75] | Terry D J, Jimmieson N L. A stress and coping approach to organisational change: Evidence from three field studies[J]. Australian Psychologist, 2003, 38(2): 92–101. |

| [76] | Thepsoonthorn C, Ogawa K I, Miyake Y. The relationship between robot’s nonverbal behaviour and human’s likability based on human’s personality[J]. Scientific Reports, 2018, 8(1): 8435. |

| [77] | Vasalya A, Ganesh G, Kheddar A. Distinct motor contagions during and after observation of actions by a humanoid co-worker[A]. Proceedings of the 27th IEEE international symposium on robot and human interactive communication[C]. Nanjing: IEEE, 2018. |

| [78] | Vogeley K, Bente G. “Artificial humans”: Psychology and neuroscience perspectives on embodiment and nonverbal communication[J]. Neural Networks, 2010, 23(8-9): 1077–1090. |

| [79] | Wall T D, Cordery J L, Clegg C W. Empowerment, performance, and operational uncertainty: A theoretical integration[J]. Applied Psychology, 2002, 51(1): 146–169. |

| [80] | Weiner B. An attributional theory of achievement motivation and emotion[J]. Psychological Review, 1985, 92(4): 548–573. |

| [81] | Willemse C J A M, van Erp J B F. Social touch in human-robot interaction: Robot-initiated touches can induce positive responses without extensive prior bonding[J]. International Journal of Social Robotics, 2019, 11(2): 285–304. |

| [82] | Worley J M, Doolen T L. The role of communication and management support in a lean manufacturing implementation[J]. Management Decision, 2006, 44(2): 228–245. |

| [83] | Yagoda R E, Gillan D J. You want me to trust a ROBOT? The development of a human-robot interaction trust scale[J]. International Journal of Social Robotics, 2012, 4(3): 235–248. |

| [84] | Złotowski J, Yogeeswaran K, Bartneck C. Can we control it? Autonomous robots threaten human identity, uniqueness, safety, and resources[J]. International Journal of Human-Computer Studies, 2017, 100: 48–54. |